シャドーAI対策ガイド|社員の隠れAI利用が招く情報漏洩リスクと防止策

「うちの会社ではAIは使っていません」──そう断言する経営者がいたとしても、社員の57%はすでに個人アカウントでChatGPTやGeminiを業務に使っているかもしれません。これが「シャドーAI」の実態です。

2023年、Samsung Electronicsのエンジニアが社内の機密ソースコードをChatGPTに入力し、取り返しのつかない情報漏洩を引き起こしました。IPAが発表した「情報セキュリティ10大脅威 2026」では、AIの利用をめぐるサイバーリスクが初選出で第3位にランクイン。シャドーAI対策は、もはやIT部門だけの課題ではなく、経営課題そのものです。

この記事では、シャドーAIの定義から実際の被害事例、法規制、そして今日から実践できる5ステップの対策まで、企業の情報セキュリティ担当者・経営者向けに体系的に解説します。筆者は、シャドーAIの本質は「社員の悪意」ではなく「善意の効率化」にあると考えています。だからこそ、全面禁止ではなく、正しいガバナンスのもとでAIを活用する戦略が必要なのです。

1. シャドーAIとは?30秒でわかる定義と現状

シャドーAIとは、企業のIT部門が把握・管理していない状態で、社員が業務に利用するAIツールのことです。個人のGoogleアカウントでGeminiにアクセスしたり、無料版のChatGPTに業務データを貼り付けたり、スマートフォンからAIアプリに議事録を入力したり──これらはすべてシャドーAIに該当します。

なぜ「シャドー(影)」なのか

従来から、IT部門の管理外で社員が勝手に利用するクラウドサービスやソフトウェアを「シャドーIT」と呼んでいました。シャドーAIはこの発展形です。しかし、従来のシャドーITとは決定的に異なる点があります。シャドーITでは、たとえば個人のDropboxにファイルを保存しても、そのデータは保存されるだけです。一方、シャドーAIに入力されたデータはAIの学習データとして取り込まれる可能性があり、一度入力すると完全な削除が困難な場合があります。言い換えれば、シャドーITが「書類をコピーされる」リスクだとすれば、シャドーAIは「書類の内容を相手の記憶に刻まれる」リスクです。

具体的なシャドーAIの例を挙げると、以下のようなケースがあります。営業担当者が提案書の文章校正をChatGPTで行う際に、取引先の未公開情報を含めてしまう。開発者がバグ修正のためにソースコードをAIに貼り付ける。人事担当者が採用候補者の評価をAIに依頼する際に、履歴書のデータをそのまま入力する──いずれも業務効率化という善意が出発点ですが、結果として機密データが外部に流出するリスクを生んでいます。

数字で見るシャドーAIの現状

シャドーAIがどれほど広がっているのか、主要な調査データを見てみましょう。

- 57%の社員が、AIツールの利用を会社に報告していない(Salesforce「Generative AI Snapshot Research」2024年)

- 27.4%の企業データがAIツールに入力される際に機密情報を含んでいる(Cyberhaven Labs 2024年3月)

- 5社に1社がシャドーAIに起因するデータ侵害を経験(IBM「Cost of a Data Breach Report 2025」)

- 37%の企業のみがAI利用ポリシーまたはシャドーAI検知の仕組みを持っている(同IBM調査)

ここで筆者が強調したいのは、シャドーAIは「悪意」から生まれるのではなく、「善意」から生まれるという点です。多くの場合、社員は業務を効率化したい、よりよいアウトプットを出したいという純粋な動機でAIを使い始めます。しかし、会社が公式なAI利用環境を用意していないため、個人アカウントで「こっそり」使わざるを得ない。これがシャドーAIの構造的な問題です。つまり、シャドーAIの責任は、使う社員ではなく、環境を整備しない組織にあるのです。

2. 実際に起きたシャドーAI事故と被害額

「うちは大丈夫」と思っている企業ほど危険です。シャドーAIによる情報漏洩は、業種や企業規模を問わず実際に発生しています。

Samsung Electronics|機密ソースコードの流出(2023年)

2023年3月、Samsung Electronicsでわずか3週間のうちに3件の情報漏洩が発生しました。エンジニアがChatGPTの社内利用解禁直後に、半導体の設備測定データベースのソースコード、設備不良を特定するプログラムコード、そして社内会議の録音データを入力したのです。ChatGPTは入力データをモデルの学習に利用する可能性があるため、これらの企業秘密は事実上OpenAIに渡ったことになります。

この事件が世界中の企業に衝撃を与えたのは、Samsungほどの大企業でさえ、AI利用を解禁してからわずか3週間で重大な情報漏洩が発生した点です。Samsungはその後、プロンプトの入力制限を1,024バイトに制限し、独自の社内AI開発に着手しました。しかし、流出したデータは取り戻すことができません。この事例は、ガイドラインなしにAI利用を解禁することの危険性を端的に示しています。

ChatGPT認証情報の大量流出(2023年)

サイバーセキュリティ企業Group-IBの調査により、2023年1月〜10月の間に22万5,000件以上のChatGPTアカウントの認証情報がダークウェブ上で売買されていたことが判明しました。情報窃取型マルウェア(LummaC2、Raccoon、RedLine)に感染した端末から抜き取られたもので、これらのアカウントを通じて、ユーザーがChatGPTに入力した業務データにもアクセスされるリスクがありました。個人アカウントでAIを使うということは、企業のセキュリティ対策の範囲外にデータを晒すということです。

シャドーAIが招く追加コスト:+67万ドル

IBMの「Cost of a Data Breach Report 2025」によると、シャドーAIが関与するデータ侵害の平均コストは463万ドル(約6.9億円)で、通常の侵害より67万ドル(約1億円)高いことがわかっています。コスト増の主な要因は、検知までの時間が長いこと(247日)、複数環境にまたがるデータ拡散(62%の事例で発生)、そしてアクセスログが存在しないことです。

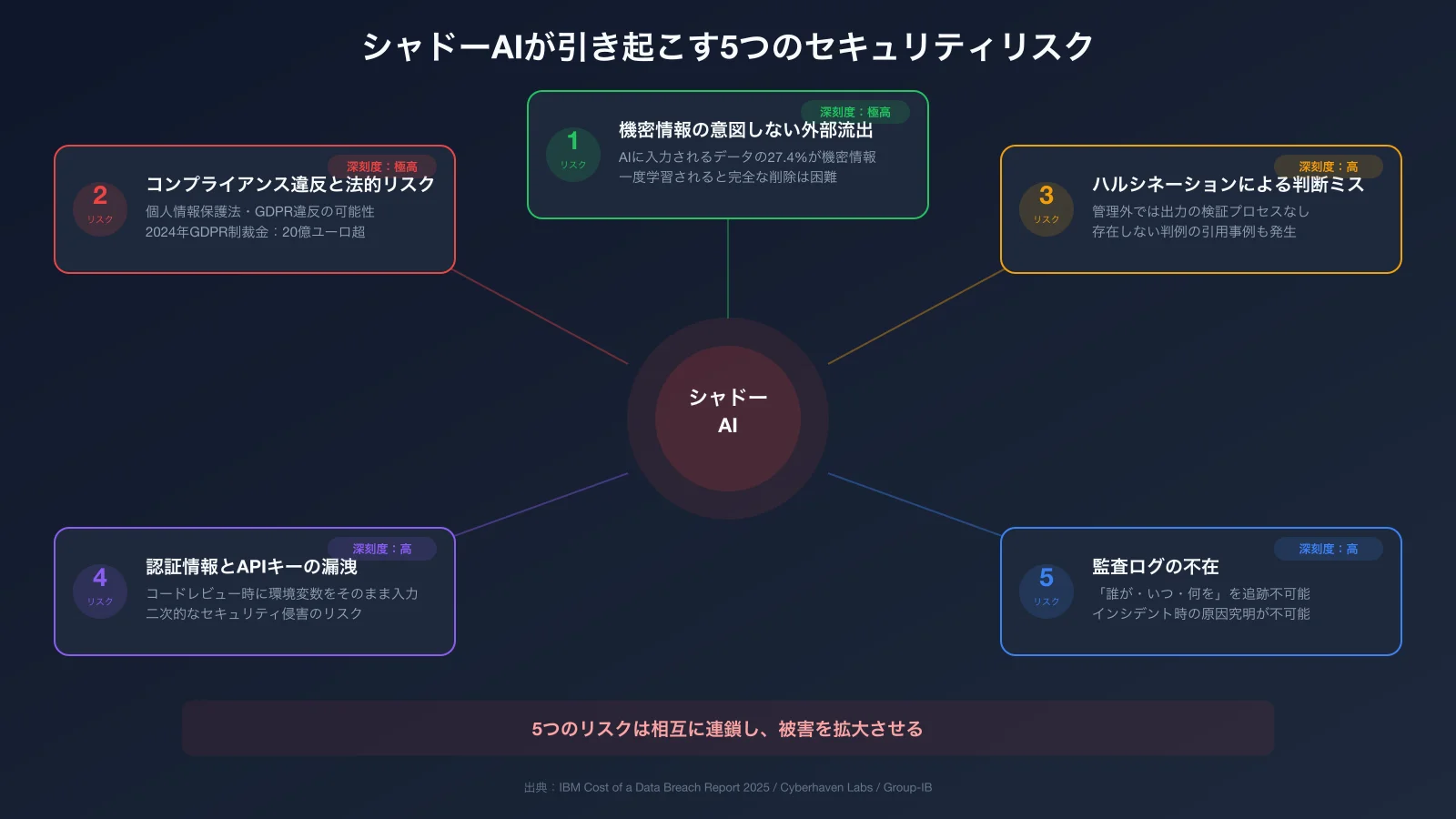

3. シャドーAIが引き起こす5つのセキュリティリスク

シャドーAIが企業にもたらすリスクは、単なる情報漏洩にとどまりません。以下の5つのリスクが相互に連鎖し、被害を拡大させます。

リスク1:機密情報の意図しない外部流出

社員が顧客情報、財務データ、ソースコードなどをAIに入力すると、そのデータはAIプロバイダーのサーバーに送信されます。無料版や個人版のAIサービスでは、入力データがモデルの学習に利用される設定がデフォルトの場合があります。Cyberhaven Labsの調査では、AIに入力されるデータの27.4%が機密情報を含んでいました。一度AIに学習されたデータは、他のユーザーへの回答に反映される可能性があり、完全な削除は技術的に極めて困難です。

リスク2:コンプライアンス違反と法的リスク

個人情報保護法、GDPR(EU一般データ保護規則)、業界固有の規制(金融業のFISC安全対策基準など)に違反するリスクがあります。社員がAIに顧客の個人情報を入力すれば、本人の同意なく第三者に個人データを提供したことになりかねません。2024年のGDPR関連の制裁金は総額20億ユーロ(約3,200億円)を超えており、「知らなかった」は免責事由になりません。

リスク3:AIの誤出力(ハルシネーション)による業務判断ミス

管理外のAI利用では、出力の検証プロセスが存在しないのが最大の問題です。AIが自信満々に提示する回答が実際には事実と異なる「ハルシネーション」を起こしている場合、それを鵜呑みにした業務判断が損害につながります。法務担当者がAIの回答を根拠に契約書をレビューした結果、存在しない判例を引用してしまったケースも報告されています。企業が管理するAI利用であれば「AIの出力は必ずダブルチェックする」というルールを全社に適用できますが、シャドーAIではこのような品質管理の仕組みが一切機能しません。

リスク4:認証情報とAPIキーの漏洩

開発者がAIにコードレビューを依頼する際に、環境変数やAPIキー、データベースの接続情報を含むコードをそのまま貼り付けてしまうケースがあります。先述の22.5万件のChatGPT認証情報流出は、こうしたシャドーAI経由で二次的なセキュリティ侵害が発生する危険性を示しています。

リスク5:監査ログの不在

企業のセキュリティインシデント対応において、「誰が・いつ・何のデータを・どのAIに入力したか」を追跡できないことは致命的です。個人アカウントでのAI利用にはアクセスログが残らないため、インシデント発生時の原因究明ができず、再発防止策も立てられません。検知できないことは安全であることとは根本的に違います。まるで、煙感知器のない部屋で「火事は起きていない」と安心しているようなものです。「見えないから問題ない」のではなく、見えないからこそ最も危険なのです。

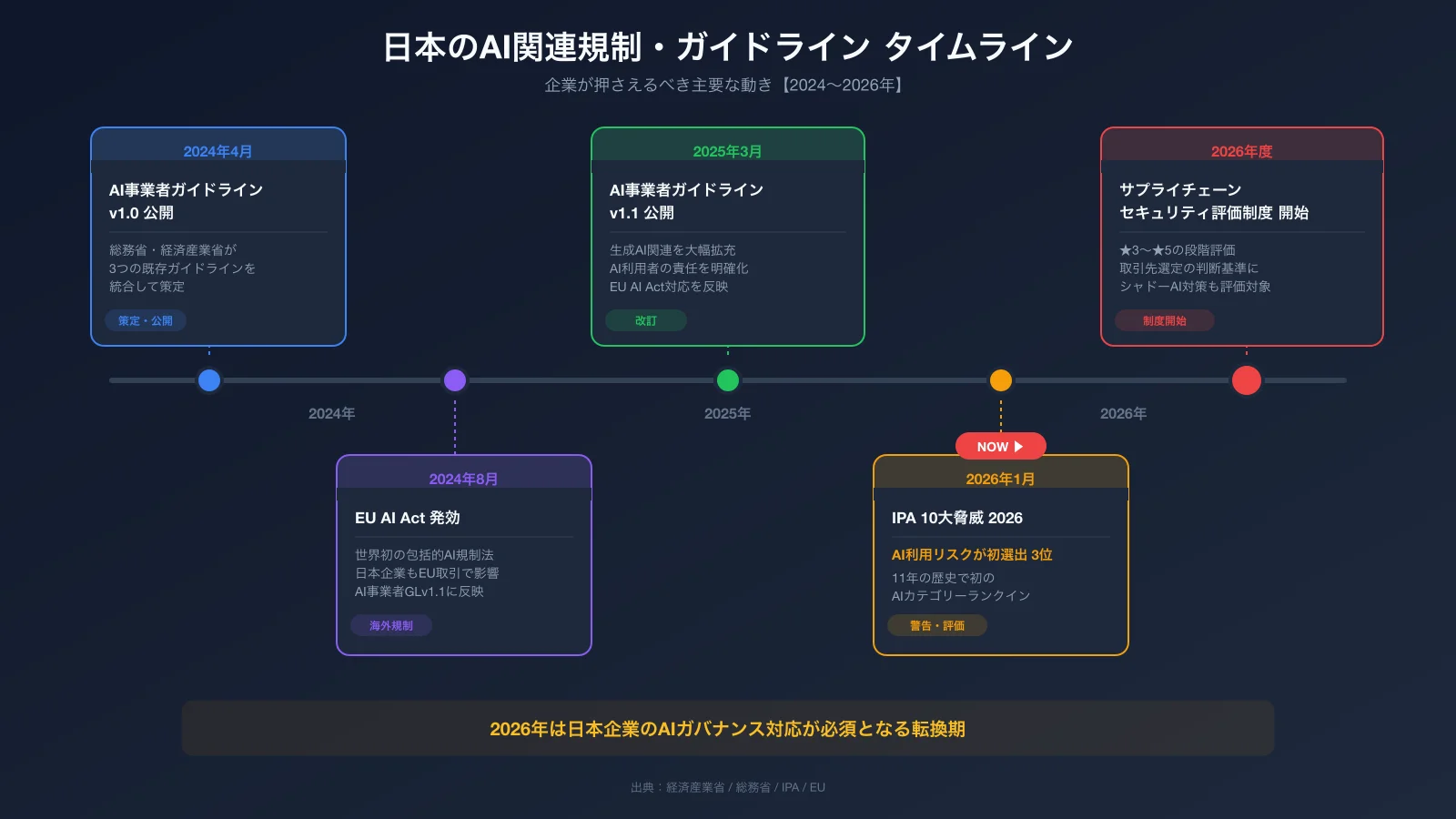

4. 日本企業が知るべき法規制とガイドライン【2026年最新】

日本でもAI利用に関する規制環境は急速に整備されています。「ガイドラインだから罰則はない」と軽視するのは危険です。ガイドラインに準拠していない企業は、取引先選定で不利になる時代が始まっています。

AI事業者ガイドライン v1.1(2025年3月)

総務省と経済産業省が共同で策定した「AI事業者ガイドライン」第1.1版が2025年3月28日に公開されました。AI開発者・提供者・利用者それぞれの立場に応じた指針を示しており、生成AIに関する記述が大幅に拡充されています。ポイントは、AI利用者(つまり一般企業)にも適切な利用ポリシーの策定と運用が求められている点です。「利用者側にも責任がある」という明確なメッセージです。

サプライチェーンセキュリティ評価制度(2026年度開始)

経済産業省が2026年度の運用開始を目指して策定中の「サプライチェーン強化に向けたセキュリティ対策評価制度」は、企業のセキュリティ対策を★3〜★5の段階で評価する仕組みです。NIST Cybersecurity Framework 2.0を基にした7分類の評価基準が設けられ、取引先企業にセキュリティ対策のレベルを可視化させることが目的です。シャドーAIへの対策は、この評価基準のうち「識別(Identify)」「防御(Protect)」「検知(Detect)」の複数カテゴリーにまたがります。

筆者はこの評価制度を「脅威」ではなく「チャンス」と捉えるべきだと考えています。なぜなら、早期に高い評価を取得した企業は、取引先選定で優位に立てるからです。特に大企業のサプライチェーンに入る中小企業にとって、セキュリティ評価は今後の受注を左右する重要な差別化要因になります。

IPA「情報セキュリティ10大脅威 2026」

IPAが2026年1月に発表した「情報セキュリティ10大脅威 2026」では、「AIの利用をめぐるサイバーリスク」が初選出で第3位にランクインしました。ランサムウェア(1位)やサプライチェーン攻撃(2位)に次ぐ位置づけです。11年の歴史を持つこのランキングにAI関連のリスクが初めて入ったことは、日本の情報セキュリティ専門家がシャドーAIを含むAIリスクを「今そこにある危機」と認識したことを意味します。

AIセキュリティの基本的な考え方については、AIエージェントの仕組みと進化を理解しておくと、リスクの本質がよりクリアに見えてきます。

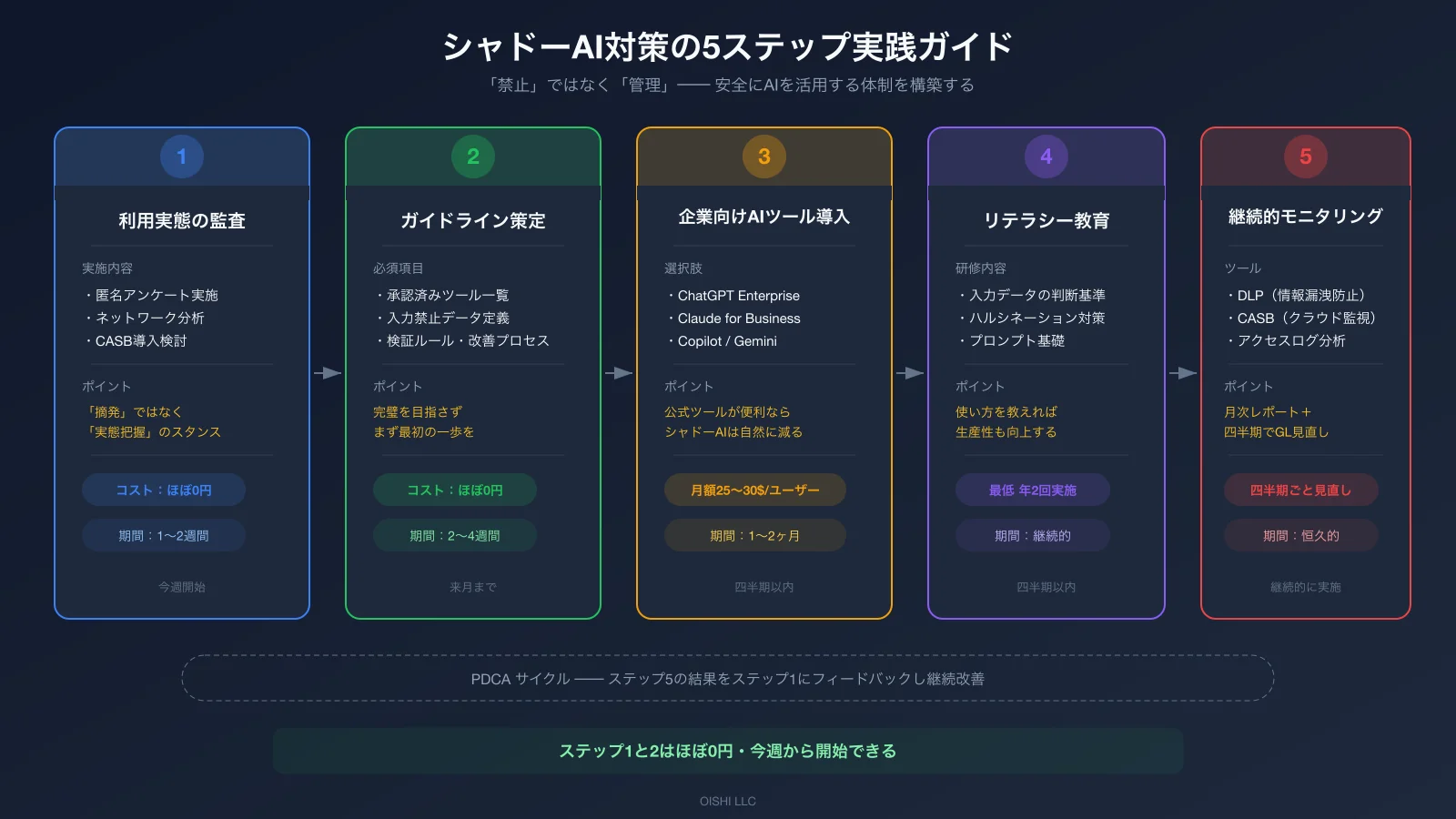

5. シャドーAI対策の5ステップ実践ガイド

シャドーAIを「禁止」するのではなく、「管理」する──これが本記事の核心です。全面禁止は逆効果です。歴史が証明しています。米国の禁酒法がかえって密造酒を蔓延させたように、AIの全面禁止は社員のシャドーAI利用をさらに地下に潜らせるだけです。以下の5ステップで、安全にAIを活用できる環境を構築しましょう。

ステップ1:現状の利用実態を監査する

まず、社員がどのAIツールを、どの頻度で、どんなデータを入力して使っているかを把握します。ちょうど健康診断のように、現状を正確に「見える化」することが治療の第一歩です。匿名アンケート、ネットワークトラフィックの分析、CASBツール(Cloud Access Security Broker)の導入などが手段です。重要なのは「摘発」ではなく「実態把握」のスタンスで行うことです。摘発目的で行うと、社員は口をつぐみ、正確な実態がわからなくなります。

ステップ2:社内AIガイドラインを策定する

実態把握の結果をもとに、「使ってよいAIツール」「入力してはいけないデータの種類」「利用時の申請・承認フロー」を明文化します。ガイドラインには最低限、以下の項目を含めてください。

- 承認済みAIツールのリスト(ホワイトリスト方式)

- 入力禁止データのカテゴリー(個人情報、ソースコード、財務情報など)

- AIの出力を業務に使う際の検証ルール(ダブルチェック体制)

- 違反時の対応プロセス(懲罰ではなく改善プロセスとして設計)

- ガイドラインの定期見直しスケジュール(四半期ごと推奨)

ステップ3:企業向けAIツールを導入する

ガイドラインだけでは不十分です。社員がシャドーAIに走る最大の理由は「公式なAI環境がない」ことです。これは、社員食堂がない会社で社員がコンビニ弁当を買うのと同じ構図です。いわば、安全な選択肢を用意するのは会社側の責任と考えるとわかりやすいでしょう。企業向けのAIプラットフォームを導入し、安全に使える環境を提供することが根本的な対策になります。次のセクションで主要なプラットフォームのセキュリティ機能を比較しますが、主要AIモデルの性能・コスト比較も導入判断の参考にしてください。

ステップ4:全社員向けのAIリテラシー教育を実施する

ツールを導入しても、正しい使い方を社員が理解していなければ意味がありません。「AIは便利だが万能ではない」「入力したデータがどう処理されるか」を全社員が理解している状態を目指します。以下のテーマで最低年2回の研修を実施しましょう。

- AIに入力してよいデータ/いけないデータの具体例(部門ごとにケーススタディを用意すると効果的)

- ハルシネーションの仕組みと検証方法(実際に誤った回答を生成するデモが印象に残りやすい)

- プロンプトエンジニアリングの基本(効果的な使い方を教えることで生産性も向上する)

- 情報漏洩が発生した場合の報告フロー(「報告した人を罰しない」文化の醸成が鍵)

教育で重要なのは、「AIを使うな」ではなく「AIを正しく使おう」というメッセージを一貫して発信することです。研修を「締め付け」ではなく「スキルアップの機会」として位置づければ、社員の参加意欲も高まります。

ステップ5:継続的なモニタリングと改善

DLP(Data Loss Prevention)ツールでAI向けのデータ流出を監視し、CASBで未承認のAIサービスへのアクセスを検知します。月次でモニタリングレポートを作成し、四半期ごとにガイドラインを見直すサイクルを回しましょう。AIの進化は速いため、半年前のガイドラインはすでに古い可能性があります。

モニタリングで追跡すべき主要指標は、「公式AIツールの利用率」「未承認AIサービスへのアクセス試行数」「機密データを含むプロンプトの検知数」の3つです。これらの指標を経営層にも定期的にレポートし、シャドーAI対策をIT部門だけの取り組みではなく、経営アジェンダとして定着させることが長期的な成功の鍵になります。

6. 企業向けAIプラットフォームのセキュリティ機能比較

シャドーAI対策の要は、社員が「公式ツールの方が便利」と感じる環境を用意することです。以下の4大AIプラットフォームの企業向けセキュリティ機能を比較します。

| 機能 | ChatGPT Enterprise / Team |

Claude for Business / Enterprise |

Gemini for Google Workspace |

Microsoft Copilot for M365 |

|---|---|---|---|---|

| 学習データへの不使用保証 | Enterprise:✅ / Team:✅ | Business:✅ / Enterprise:✅ | ✅(Workspace契約) | ✅ |

| SOC 2 Type II | ✅ | ✅ | ✅ | ✅ |

| SSO / SAML対応 | Enterprise:✅ / Team:❌ | Enterprise:✅ / Business:✅ | ✅(Google Workspace連携) | ✅(Entra ID連携) |

| SCIM(自動プロビジョニング) | Enterprise:✅ | Enterprise:✅ | ✅ | ✅ |

| 管理コンソール | ✅(利用状況ダッシュボード) | ✅(Usage Dashboard) | ✅(Google Admin Console統合) | ✅(Microsoft 365管理センター統合) |

| DLP連携 | API経由で対応 | API経由で対応 | Google DLP統合 | Microsoft Purview統合 |

| データ保存リージョン指定 | Enterprise:✅(US/EU) | Enterprise:✅ | ✅(Google Cloudリージョン) | ✅(M365データ境界) |

| 監査ログ | Enterprise:✅ | Enterprise:✅ | ✅(Google Workspace監査ログ) | ✅(Microsoft 365統合監査ログ) |

選択のポイントは既存のIT基盤との親和性です。Google Workspaceを全社導入している企業ならGemini、Microsoft 365環境ならCopilotが、SSO・DLP・監査ログが既存基盤とシームレスに統合されるため、最もスムーズに導入できます。一方、AI性能を重視する場合はClaude for BusinessやChatGPT Enterpriseも有力な選択肢です。AI性能そのものの比較はGemini vs Claude vs GPT 徹底比較を参照してください。

なお、複数のAIプラットフォームを併用する企業も増えています。たとえば、Microsoft 365環境にCopilotを標準導入しつつ、高度な文章生成やコーディングにはClaude Enterpriseを併用するといった構成です。重要なのは、どのプラットフォームを使う場合でも、企業契約を通じてデータ保護とアクセス管理が確保されていることです。個人アカウントでの利用さえ防げれば、シャドーAIのリスクは大幅に低減されます。

7. 経営者・IT管理者が今日やるべき3つのアクション

ここまでの内容を踏まえ、タイムラインごとに具体的なアクションを整理します。

今週やること:実態把握の開始

まず匿名のAI利用アンケートを全社に配信してください。「あなたはAIを業務で使っていますか?」「何のツールを使っていますか?」「どんな業務に使っていますか?」──シンプルな3問で構いません。回答を強制せず、「環境改善のための調査であり、摘発目的ではない」と明記することが重要です。

来月までにやること:ガイドラインのドラフト作成

アンケート結果をもとに、社内AIガイドラインの初版を作成します。完璧を目指す必要はありません。まずは最低限の「やってよいこと・いけないこと」を明文化し、全社に周知しましょう。ガイドラインは四半期ごとに更新すればよいので、最初の一歩を踏み出すことが最も重要です。

四半期以内にやること:企業向けAIの試験導入

シャドーAI利用が多い部門を対象に、企業向けAIプラットフォームのパイロット導入を開始します。1部門10〜30名規模でのパイロットなら、多くのプラットフォームで月額数万円から始められます。効果測定のKPIは「シャドーAI利用率の低下」ではなく、「公式AI利用率の上昇」に設定してください。禁止を測るのではなく、活用を促進する指標を追うのです。

「ひとりAIチーム」の実践事例でも紹介していますが、AIを正しく活用できる環境さえ整えれば、少人数でも大企業並みのアウトプットが可能になります。シャドーAI対策は、単なるリスク回避ではなく、AIによる競争力強化の第一歩でもあるのです。

なお、本記事はAI×セキュリティシリーズの第1弾です。次回はAIを活用した最新のセキュリティ対策技術について、より実践的な内容をお届けします。

よくある質問

Q1. シャドーAIは全面禁止すべきですか?

全面禁止はおすすめできる方法ではありません。禁止しても社員は見えないところでAIを使い続けるため、かえってリスクが高まります。企業向けの安全なAI環境を提供し、ガイドラインのもとで活用を促進する方が、セキュリティと生産性の両立につながります。

Q2. 社内AIガイドラインには何を書けばよいですか?

最低限含めるべき項目は、承認済みツールのリスト、入力禁止データのカテゴリー、AIの出力を業務に使う際の検証ルール、違反時の改善プロセス、ガイドラインの見直しスケジュールの5つです。経済産業省の「AI事業者ガイドライン v1.1」の付属資料に具体的なチェックリストが掲載されているので、参考にしてください。

Q3. 無料版のChatGPTと企業版は何が違いますか?

最大の違いはデータの取り扱いです。無料版ではデフォルトで入力データがモデルの学習に利用される可能性がありますが、企業版(ChatGPT Enterprise/Team)では学習に一切使用されないことが契約で保証されます。さらに企業版では、SSO、監査ログ、管理コンソール、データ保存リージョンの指定など、エンタープライズ向けのセキュリティ機能が利用できます。

Q4. シャドーAI対策にはどのくらいのコストがかかりますか?

段階的に進めれば、初期コストを抑えられます。ステップ1(監査)とステップ2(ガイドライン策定)はほぼ0円で実施可能です。ステップ3(ツール導入)は、ChatGPT TeamやClaude for Businessの場合、1ユーザーあたり月額25〜30ドル(約3,750〜4,500円)程度です。まず少人数でパイロット導入し、効果を確認してから全社展開する方法が現実的です。

Q5. 従業員数が少ない中小企業でも対策は必要ですか?

むしろ中小企業こそ必要です。大企業にはインシデント対応の専門チームがいますが、中小企業にはない場合がほとんどです。一度情報漏洩が発生すると、信用の回復に大企業よりもはるかに時間がかかります。まずはガイドラインの策定(0円)と、少人数での企業向けAIの試験導入から始めてみてください。

まとめ

シャドーAIは、社員の「もっと効率よく仕事がしたい」という善意から生まれる構造的な問題です。Samsung事件や22.5万件の認証情報流出が示すように、リスクは現実のものです。そしてIBMのデータが示す通り、対策を怠れば平均67万ドルの追加コストがのしかかります。

しかし、対策は「禁止」ではありません。利用実態の把握→ガイドライン策定→安全な環境の提供→教育→モニタリングの5ステップで、AIの生産性向上とセキュリティを両立できます。2026年はIPA 10大脅威にAIリスクが初選出され、サプライチェーン評価制度も始まる転換期です。今動き出した企業が、競争力を得られます。

まずは今週、たった3問の匿名アンケートから始めてみてください。

参照元

- Salesforce「The Promises and Pitfalls of AI at Work」(2024年)

- Cyberhaven Labs「Shadow AI: Employee AI Adoption Risks」(2024年)

- IBM「Cost of a Data Breach Report 2025」

- The Hacker News「Over 225,000 Compromised ChatGPT Credentials」(2024年3月)

- TechRadar「Samsung workers made a major error by using ChatGPT」(2023年)

- IPA「情報セキュリティ10大脅威 2026」

- 経済産業省・総務省「AI事業者ガイドライン(第1.1版)」(2025年3月)

- 経済産業省「サプライチェーン強化に向けたセキュリティ対策評価制度」構築方針(2025年12月)

- Gartner「The Impacts of Shadow AI on Digital Employee Experience」