Google Gemma 4 完全ガイド|無料で商用利用できる最強オープンモデルの実力と始め方

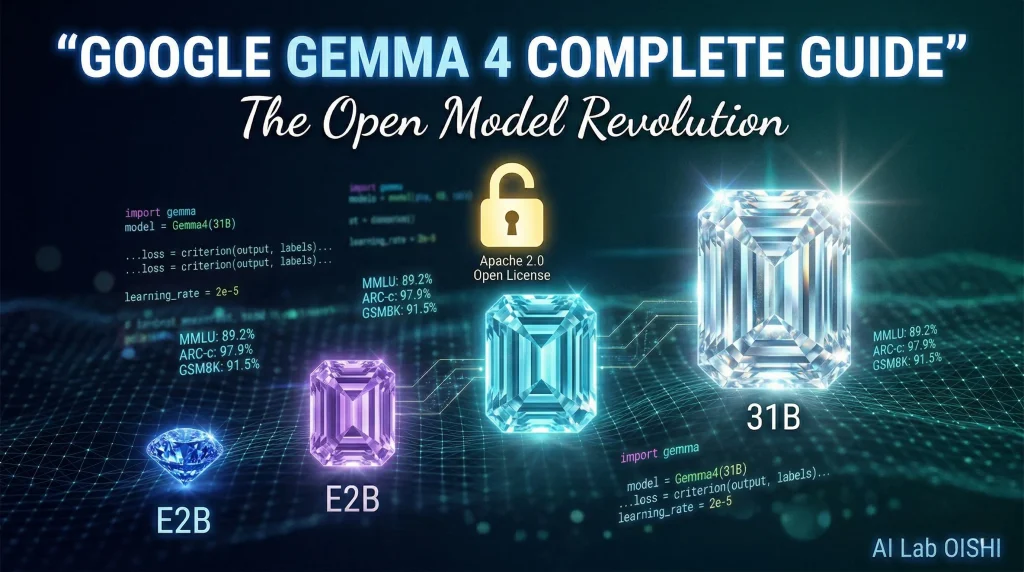

2026年4月2日、Google DeepMindが発表したGemma 4は、オープンモデルの常識を書き換えるリリースでした。数学オリンピック級の推論ベンチマークAIME 2026で89.2%を叩き出し、前世代Gemma 3の20.8%から一気に4倍以上のスコアに。しかもライセンスはApache 2.0に変更され、誰でも無料で商用利用できるようになりました。

最小モデルはRaspberry Pi 5で動き、最大モデルはクローズドモデルのトップ層と肩を並べる。4つのモデルサイズ、マルチモーダル対応、140以上の言語サポート。この記事では、Gemma 4の全容を技術的な裏側まで掘り下げ、「結局どのモデルをどう使えばいいのか」を実践的に解説します。AI初心者の方から、ローカルLLMの導入を検討している企業のIT担当者まで、Gemma 4を理解するために必要な情報をすべてお伝えします。

なぜGemma 4が”事件”なのか — Apache 2.0とAIME 4倍の衝撃

「オープンモデル」と聞くと、「無料だけど性能はそこそこ」というイメージを持つ方も多いかもしれません。Gemma 4はその認識を根底から覆します。

まず、ライセンスの転換が決定的です。Gemma 3までは独自のGemmaライセンスが適用され、商用利用には一定の制約がありました。Gemma 4ではApache 2.0に変更。これは、いわば厳重に施錠されていた金庫の鍵が完全に外されたような変化です。改変、再配布、派生モデルの販売、すべてが制限なく可能になりました。Linuxカーネルと同じライセンスで、ソースコード公開義務もありません。

そしてもう1つの衝撃が、性能の飛躍的な向上です。数学推論ベンチマークAIME 2026で31Bモデルが89.2%を記録。Gemma 3の27Bモデルは20.8%でした。テストの点数が20点から90点に跳ね上がったようなものです。1世代で4.3倍という進化幅は、AI業界でも異例中の異例と言えます。

さらに、人間による主観評価を行うLMArena(旧Chatbot Arena)では、31BモデルがElo 1452でテキスト部門3位にランクイン。26B MoEモデルも6位に食い込んでいます。クローズドモデル(ChatGPT、Claude、Gemini)の中に、オープンモデルが堂々と割って入った形です。

Google DeepMindのClement Farabet氏が公式ブログで発表したGemma 4は、Gemini 3の技術をベースに構築されたオープンウェイトモデルです。Gemmaシリーズは累計4億回以上ダウンロードされ、10万以上の派生モデルが生まれています。その最新世代であるGemma 4は、名実ともにオープンモデルのフラッグシップとなりました。CodeGemma(プログラミング特化)やPaliGemma 2(視覚処理特化)といった専門派生モデルも含めると、Gemmaファミリーは多様な用途をカバーするエコシステムへと成長しています。

Gemma 3から何が変わったのか — 進化のポイントを整理

Gemma 4がGemma 3から何が変わったのか、4つの軸で整理していきましょう。

ライセンスの大転換 — 独自ライセンスからApache 2.0へ

これがGemma 4で最も重要な変更点であり、技術的な性能向上以上にインパクトが大きいと筆者は考えています。Gemma 3はGoogle独自のGemmaライセンスで公開されており、月間アクティブユーザー(MAU)制限や特定の利用制約がありました。企業が本番サービスに組み込む際に、法務部門がライセンス条件を慎重に確認する必要があり、これが導入の足かせになっていたケースは少なくありませんでした。

Gemma 4ではこれがApache 2.0に変更されました。MAU制限なし、利用用途の制限なし、派生モデルの販売も自由。Linuxカーネルやkubernetesと同じライセンスですから、エンタープライズでの採用ハードルが一気に下がりました。法務部門が「このモデル、本番に使っていいの?」と聞かれたら、「Apache 2.0です」の一言で説明が終わるようになったのです。

マルチモーダル対応の大幅拡大

Gemma 3はテキストと画像にしか対応していませんでした。Gemma 4では全モデルで動画対応(最大60秒、1fps)が追加され、小型モデル(E2B・E4B)では音声入力(最大30秒)にも対応しています。テキストだけでなく、目で見て耳で聞いたものを理解できるAIに進化したわけです。

画像処理も強化されています。可変解像度に対応し、70/140/280/560/1120トークンから最適な解像度を選択できるようになりました。低解像度で大まかに把握してから、必要な箇所だけ高解像度で分析する——人間が書類を目を通すときの自然な振る舞いに近い処理が可能になっています。

コンテキスト長の拡大と多言語対応

E2B・E4Bモデルは128Kトークン、26B・31Bモデルは256Kトークンのコンテキスト長をサポートします。日本語の書籍に換算すると、256Kトークンは約10万文字。新書1冊分をまるごと読み込める計算です。

言語サポートも充実しています。140以上の言語で事前学習が行われ、日本語を含む35以上の言語をネイティブにサポート。語彙サイズは262Kトークンで、多言語処理の効率が大幅に向上しています。日本語、英語、中国語、韓国語といった主要言語はもちろん、ヒンディー語やアラビア語、インドネシア語など、グローバル展開を視野に入れた企業にとって心強いカバレッジです。

エージェント機能のネイティブ搭載

Gemma 4は全モデルサイズでネイティブ関数呼び出し(Function Calling)に対応しています。外部ツールとの連携やワークフローの自動化を前提に設計されており、AIエージェントの基盤モデルとして活用できます。自律的にツールを呼び出し、結果を解釈し、次のアクションを決定する。そうしたAIの「自走」を、オープンモデルでも実現できる時代になったのです。

たとえば「明日の東京の天気を調べて、雨なら会議をリモートに変更して」という指示に対して、天気APIを呼び出し→結果を判断→カレンダーAPIを操作する、という一連のアクションをGemma 4が自律的に実行できます。これまでクローズドモデル(ChatGPTやClaude)でしかできなかった高度なエージェント動作が、自社サーバー上のオープンモデルで実現できるようになったわけです。

4つのモデルを理解する — E2Bから31Bまでの選び方

Gemma 4は4つのモデルサイズで構成されています。「どれを選べばいいのか」はよくある疑問ですが、それぞれに明確な役割分担があります。洋服のS/M/L/XLのように、目的と環境に合ったサイズを選ぶことが大切です。ここでは各モデルの特徴を、技術的な詳細とともに解説します。

E2B(有効パラメータ 2.3B)— ポケットに入るAI

総パラメータ5.1Bのうち有効パラメータは2.3B。128Kトークンのコンテキスト長を持ち、テキスト・画像・動画に加えて音声入力にも対応する完全マルチモーダルモデルです。4bit量子化時のVRAM使用量は約5GBで、驚くべきことにRaspberry Pi 5でも動作します(2bit量子化で133 tok/s prefill、7.6 tok/s decode)。

まさにポケットに入るAI。スマートフォンやIoTデバイス、組み込みシステムへのAI搭載を考えているなら、最有力の候補です。「ネットに繋がらなくてもAIが使える」環境を作りたい場合に、真っ先に検討すべきモデルです。

E4B(有効パラメータ 4.5B)— 個人PCの最適解

総パラメータ8Bで有効4.5B。E2Bと同じく128Kコンテキスト・音声対応のフルマルチモーダルですが、より高い推論精度を備えています。VRAMは約6GBで、一般的なゲーミングPCやM1/M2 MacBook Airでも快適に動作します。「自分のPCでAIを使いたいけれど、そこまでハイスペックじゃない」という方にちょうどいいモデルです。JCommonsenseQAで93.5%と、日本語の常識推論も十分な精度を持っています。

26B A4B MoE(有効パラメータ 3.8B)— コスパの怪物

ここがGemma 4で最も面白いモデルです。総パラメータは25.2Bですが、推論時に実際に使うのはわずか3.8B。128個のエキスパートモジュールのうち、各トークンごとに最適な8個+1個の共有エキスパートだけが活性化するMoE(Mixture of Experts)アーキテクチャを採用しています。

イメージとしては、高級レストランのビュッフェに近いでしょう。100品以上の料理が用意されていますが、一度に食べるのは自分が選んだ数皿だけ。全料理の品質は担保されつつ、実際のリソース消費は最小限に抑えられます。

結果として、このモデルは31B Denseの約97%の性能を、はるかに少ない計算リソースで発揮します。256Kコンテキスト対応で、VRAMは約18GB。コストと性能のバランスを追求するなら、最有力の選択肢です。LMArenaでもElo 1441で全モデル6位にランクインしており、人間の主観評価でも高い満足度が確認されています。多くのユースケースで、この26B MoEが「実質的なベストチョイス」になるでしょう。

31B Dense(有効パラメータ 30.7B)— 最高性能

全パラメータが常に活性化するDense(密結合)モデル。AIME 89.2%、Arena Elo 1452、Codeforces 2150と、あらゆるベンチマークで最高スコアを記録します。256Kコンテキスト対応で、VRAMは約20GB。RTX 4090やApple Silicon M3 Max以上を持っている方、あるいはクラウドGPUで最高性能を追求したい方向けです。

「じゃあ26B MoEがあれば31Bは不要では?」と思うかもしれません。MoEモデルは効率的ですが、一部の高度な推論タスクや長い文脈を要する処理では、Denseモデルの方が安定した出力を返す傾向があります。研究開発やベンチマーク再現性が重要な用途では、31B Denseを選ぶ価値があります。

ちなみに、4つのモデルすべてに「IT(Instruction Tuned)」版が用意されています。IT版は人間の指示に従う能力が最適化されたバージョンで、チャットボットやアシスタント用途にはIT版を使うのが基本です。ベースモデルはファインチューニングの素材として使います。OllamaやGoogle AI Studioで利用できるのは、すべてIT版です。

ベンチマーク徹底比較 — 数字で見るGemma 4の実力

「すごい」という定性的な話だけでは判断材料になりません。AIモデルの性能は「何となく賢い」ではなく、標準化されたテストの数字で比較するのが鉄則です。ここでは主要ベンチマークの数字を、競合モデルと横並びで比較します。

推論・数学能力

AIME 2026(アメリカ招待数学試験レベルの問題)で31Bモデルが89.2%を記録。これはGemma 3の20.8%から68.4ポイントの向上です。26B MoEモデルも88.3%と、有効パラメータわずか3.8Bでほぼ同等のスコアを出しています。

GPQA Diamond(大学院レベルの科学質問)では31Bが84.3%。同じくオープンモデルのMeta Llama 4 Scout(109B)の57.2%を27ポイント上回っています。パラメータ数は約3分の1なのに性能は圧倒的に上。効率の良さが際立ちます。

MMLU Pro(幅広い学術知識のテスト)では31Bが85.2%、26B MoEが82.6%を記録。Gemma 3の67.5%から大幅に向上しています。BigBench Extra Hard(非常に難しい推論タスクの集合)でも74.4%を記録しており、Gemma 3の19.3%から55ポイント以上の飛躍です。この数字を見ると、Gemma 4が「世代交代」ではなく「次元の異なる進化」を遂げたことが分かります。

コーディング能力

Codeforces ELOで31Bが2150を記録。これは競技プログラミングの「紫」ランク(上位数%)に相当するレベルです。LiveCodeBench v6でも80.0%と、コーディングタスクへの対応力の高さを示しています。Claude CodeのようなAIコーディングツールの基盤としても注目される数字です。

日本語性能

日本語ユーザーにとって最も気になるポイントでしょう。JCommonsenseQA v1.1(日本語の常識推論テスト)で31Bモデルが97.9%を達成。これは従来のオープンモデルの最高記録93.9%を4ポイント上回る結果です。

26B MoEモデルも96.4%、E4Bですら93.5%と、日本語処理での精度は全サイズで高水準を維持しています。DevelopersIOの検証によると、多言語ベンチマークMMMUでも88.4%(31B)と、多言語対応の強さが確認されています。

これは日本語で社内チャットボットやカスタマーサポートAIを構築する際に、非常に心強い数字です。「日本語のオープンモデルは英語に比べて性能が落ちる」という従来の常識に、Gemma 4は明確に反論しています。特に、有効パラメータ3.8Bの26B MoEモデルが96.4%を出しているのは驚異的で、限られたハードウェアリソースでも日本語タスクを高精度にこなせることを意味しています。

ただし注意点もあります。MRCR v2 128K(長文脈の理解テスト)では31Bでも66.4%と、他のベンチマークほどの高スコアではありません。長い文書の中から特定の情報を正確に取り出すタスクでは、まだ改善の余地があるということです。とはいえ、Gemma 3の13.5%からは大幅に改善しており、世代ごとの進化のスピードを考えれば、次世代でさらに向上することが期待できます。

Arena AI(LMArena)での人間評価

自動ベンチマークだけでなく、人間による主観評価も重要です。LMArenaのテキストリーダーボードで31BモデルはElo 1452で3位に、26B MoEモデルはElo 1441で6位にランクインしています。自動ベンチマークでは僅差のモデルでも、人間が実際に使ってみるとGemma 4の回答を好む傾向が確認されています。

ここで注目すべきは、26B MoEモデルの効率性です。有効パラメータわずか3.8Bで、30.7Bフルに稼働する31B Denseモデルにわずか11ポイント差(Elo 1441 vs 1452)まで迫っている。使うリソースが8分の1なのに、性能差は1%未満。企業がコストと性能のトレードオフを考える際に、この数字は極めて重要な判断材料になります。

今日から使える — Gemma 4の始め方ガイド

性能が高くても、使い始められなければ意味がありません。「すごいモデルがあるらしいけど、どうやって触るの?」という疑問に答えるため、ここでは4つの方法を手軽さ順に紹介します。いずれの方法も無料で始められます。

Ollama — ターミナル1行で始める(最も手軽)

Ollamaは、ローカルLLMを最も簡単に動かせるツールです。v0.20.0以降でGemma 4に対応しています。

インストール後、ターミナルで以下を実行するだけです。

# デフォルト(E4B)で起動

ollama run gemma4

# モデルサイズを指定

ollama run gemma4:e2b # 最小モデル

ollama run gemma4:e4b # 個人PC向け

ollama run gemma4:26b # MoEモデル

ollama run gemma4:31b # 最高性能ダウンロードが完了すれば、そのまま対話が始まります。インターネット接続不要で、データはすべてローカルに留まります。プライバシーが気になる質問でも、安心して投げかけることができます。

Ollamaの良いところは、モデルの切り替えが非常に簡単なこと。「まずE4Bで試して、物足りなければ26B MoEに上げる」というステップアップが、コマンド1つで実現できます。初めてローカルLLMを触る方には、最もおすすめの入口です。

Google AI Studio — ブラウザだけで無料利用

PCにソフトをインストールしたくない方には、Google AI Studioがおすすめです。Googleアカウントがあれば無料で利用できます。対応モデルはgemma-4-26b-a4b-itとgemma-4-31b-itの2種類。Google AI Studioの使い方は別記事で詳しく解説していますので、初めての方はそちらもご覧ください。

無料枠にはレート制限がありますが、個人の検証や学習用途には十分な枠です(具体的な数値は変動するため、公式の料金ページをご確認ください)。

Hugging Face — 開発者向けの本格利用

Hugging Faceでは、ベースモデル・IT(Instruction Tuned)モデルの両方が公開されています。transformersライブラリのpipeline APIで直接利用できるほか、GGUF量子化版やApple Silicon最適化のMLX版も提供されています。

ファインチューニングや本番アプリケーションへの組み込みを検討している開発者には、最も柔軟な選択肢です。GGUF形式のモデルはファイルサイズが小さく、量子化のレベルも選べるため、ハードウェアに合わせた最適な構成を組むことができます。

OpenRouter API — コスト重視の外部連携

OpenRouter経由でAPIアクセスも可能です。31Bモデルで入力$0.14/百万トークン、出力$0.40/百万トークン。GPT-4oの100分の1以下という驚異的な価格設定です。既存のアプリケーションにAPI経由でGemma 4を組み込みたい場合に適しています。OpenAIやAnthropicのAPIと同じ感覚で、エンドポイントを切り替えるだけで利用できるため、移行コストも最小限です。

ライバル比較 — Llama 4・Qwen 3.5と何が違うのか

2026年春のオープンモデル市場は、かつてないほど競争が激化しています。Gemma 4の発表と同日にAlibaba Qwen 3.6-Plusもリリースされるなど、まさに群雄割拠の様相です。「どのオープンモデルを選ぶべきか」は多くの開発者・企業が直面している問題ですので、主要な競合と具体的に比較してみましょう。

vs Meta Llama 4 Scout(109B)

Llama 4 Scoutは総パラメータ109Bの大型MoEモデルです。10Mトークンという圧倒的なコンテキスト長が最大の武器で、日本語の書籍数百冊分に相当するテキストを一度に処理できます。しかし、性能面ではGemma 4 31Bに及びません。GPQA Diamondで84.3%対57.2%と27ポイント差。パラメータ数が約3分の1のGemma 4が圧倒的に上回っています。

もう1つの決定的な違いがライセンスです。Llama 4はCommunity Licenseで、月間アクティブユーザー(MAU)7億人超の企業はMetaとの個別契約が必要。一方のGemma 4はApache 2.0で一切の制限なし。企業が本番サービスに組み込む際の法務リスクは、Gemma 4の方が明らかに低いです。ライセンスの自由度は、いわばビジネスの滑走路の長さ。制限が多いほど離陸できる事業の規模が限られます。

vs Alibaba Qwen 3.5-27B

Qwen 3.5-27Bは、ベンチマークによってはGemma 4 31Bをわずかに上回ります。MMLU Pro(86.1%対85.2%)やGPQA Diamond(85.5%対84.3%)ではQwen優位。一方でAIME 2026やCodeforces ELOではGemma 4が優位と、ほぼ互角の戦いで���。総合力では甲乙つけがたく、「Gemma 4とQwen 3.5のどちらかが明確に上」とは現時点では言えません。

ライ���ンスは両者ともApache 2.0で同等。選択のポイントは用途次第です。Qwen 3.5は201言語対応と250K語彙で多言語カバレッジに優れ��Gemma 4はMoEの効率性とマルチモーダル対応で差別化しています。なお、Gemma 4の発表と同日にAlibabaはQwen 3.6-Plus(1Mトークンコンテキスト)をリリースしており、オープンモデル市場の競争の激しさを象徴しています。

ライセンス比較 — 企業にとっての「自由度」

| 項目 | Gemma 4 | Llama 4 | Qwen 3.5 |

|---|---|---|---|

| ライセンス | Apache 2.0 | Community License | Apache 2.0 |

| 商用利用 | 完全自由 | MAU 7億超は個別契約 | 完全自由 |

| 派生モデル販売 | 制限なし | Metaの利用規約に準拠 | 制限なし |

| ソース公開義務 | なし | なし | なし |

クローズドモデル(ChatGPT、Claude、Gemini)との性能差は急速に縮まっています。三大AIの比較も参考にしながら、自社に最適なモデル選定を行ってみてください。

補足として、DeepSeek V3.2-SpecialeがIMO/IOI/ICPC 2026で金メダルを獲得するなど、中国発のオープンモデルも急速に実力をつけています。ただし、DeepSeekは多段推論の超高難度タスクに特化している面があり、汎用性と効率性のバランスではGemma 4が優位です。「どんな用途にも80点以上の回答を返せる汎用性」がGemma 4の強みであり、特定タスクの最高精度を追求するなら各分野のスペシャリストモデルと使い分けるのが現実的な戦略でしょう。

企業で使うなら — 商用利用とビジネス活用の可能性

Apache 2.0ラ���センスへの変更��、企業のAI戦略に直接的なインパクトを与えます。ここでは、具体的なビジネス活用のシナリオを整理します。

ファインチューニングによるカスタマイズ

Gemma 4のモデルウェイトはすべて公開されているため、自社のデータでファインチューニングが可能です。たとえば、社内のマニュアルや技術文書で追加学習を行い、自社専用のAIアシスタントを構築できます。Apache 2.0なので、そのファインチューニング済みモデルを自社製品の一部として販売することも可能です。

具体的なユースケースを挙げると、不動産会社が物件情報のデータベースでファインチューニングし、顧客の条件に合った物件を自然言語で提案するAIアシスタントを構築する。法律事務所が判例データで追加学習し、類似判例の検索と要約を行う社内ツールを作る。いずれもApache 2.0の��かげで、ライセンス料も月額費用もゼロで実現できます。

オンプレミスでのデータ管理

クラウドAPIを使う場合、データが外部に送信されることへの懸念は常にあります。Gemma 4をローカルサーバーやオンプレミス環境で運用すれば、データは一切社外に出ません。医療、金融、法務など、データの機密性が極めて高い業界でも安心して利用できます。

RAG(検索拡張生成)との組み合わせ

Gemma 4の長いコンテキスト長(256Kトークン)は、RAGシステムとの相性が抜群です。社内のナレッジベースやドキュメントを検索し、関連する情報をコンテキストに注入してから回答を生成する。このワークフローにおいて、256Kトークンは「検索結果を十分に含められるバケツの容量」です。新書1冊分に相当する情報を一度に処理できるため、複雑な質問にも文脈を踏まえた正確な回答を返せます。

実際に、オンプレミスのGemma 4 + ベクトルDBの構成で社内FAQシステムを構築するケースが増えています。Gemma 3のころは128Kトークンが上限でしたが、256Kに拡張されたことで、より多くの関連文書を同時参照できるようになりました。

コスト試算 — APIとローカル運用の損益分岐点

OpenRouter経由のAPI利用では、31Bモデルで入力$0.14/百万トークン。月間100万リクエスト(各1,000トークン)を処理した場合、月額約$140(約2万円)。一方、RTX 4090(約30万円)を1台購入してローカル運用すれば、電気代を除けばランニングコストはほぼゼロ。処理量が多いほどローカル運用が有利になります。

損益分岐点を大まかに計算すると、月間のAPI利用料が約2万円を超える場合(月100万リクエスト以上)は、ローカルGPUの方が15ヶ月程度で元が取れます。逆に月数千リクエスト程度の利用なら、APIの方がはるかに安上がりです。自社の想定利用量に合わせて、初期投資とランニングコストのバランスを見極めましょう。

なお、Google Cloud(Vertex AI)やAWS、Azureでのマネージドデプロイも可能です。オンプレミスの管理コストを避けつつ、専用のGPUインスタンスでGemma 4を運用するハイブリッドなアプローチも選択肢の1つです。NotebookLMなど他のGoogleサービスとの連携を視野に入れる場合は、Google Cloudに揃えるメリットがあります。

AIデスクトップアプリの比較も含め、自社の利用パターンに合った方���を選ぶことが大切です。

エッジAI — 工場やリテールの現場で

E2BやE4Bの小型モデルは、工場の検品ライン、小売店舗のデジタルサイネージ、車載システムなど、エッジデバイスへの組み込みを想定して設計���れています。E2Bモデ��がRaspberry Pi 5で動作するということは、1台数万円の端末にAIを搭載できるということ。大規模な設備投資なしに、現場レベルでAIを活用できる道が開けています。

たとえば製造業の検品ラインで、カメラ映像をE2Bモデルにリアルタイムで入力し、不良品を自動検出する。従来はクラウドに映像を送信して判定結果を返す構成が一般的でしたが、ローカル処理ならネットワーク���延もプライバシーリスクもありません。

注意点 — Gemma 4の現時点での課題

優れたモデルであることは間違いありませんが、「完璧なモデル」は存在しません。導入を検討するなら、現時点の課題も正確に把握しておく��要があります。

MoEモデルの推論速度

リリース直後から開発者フォーラムで「26B MoEモデルの動作速度に問題がある」という報告が相次いでいます。「モデルの性能は印象的だが、実行体験は印象的ではない」という声もあり、vLLMやTransformersといったツールチェーンの最適化がまだ追いついていない状況です。

いわば、素晴らしい船が建造されたものの、港のインフラがまだ整っていない状態。モデル自体の品質は高いので、エコシステムの成熟とともに改善されていくことが期待されます。

Thinking Modeの日本語知識問題

DevelopersIOの検証によると、Thinking Mode(段階的推論モード)を使用した場合、日本語の知識ベース5択問題で全モデルの成績が低下する現象が確認されています。26B MoEモデルでは9.2ポイントの低下が報告されています。数学的推論ではThinking Modeが有効ですが、日本語の知識問題ではオフにした方が良い結果が得られる場合があります。

これは直感に反する結果です。「考えるモードをオンにすれば、より正確な回答が返るはず」と期待するのが自然ですが、日本語の知識ベース問題では余計な推論が逆効果になっているようです。Ollamaで利用する場合は、デフォルト(Thinking Modeオフ)で始めて、数学やコーディングの問題だけThinking Modeをオンにする、という使い分けが現時点でのベストプラクティスです。

エコシステムの発展途上

Interconnectsの分析では、「ベンチマークはリリース時の極めて不完全なストーリー。Gemma 4の真の成功はエコシステムの成熟度にかかっている」と指摘されています。過去のGemmaシリーズでもツーリングの安定性が課題でした。リリースから日が浅いため、本番環境での採用は十分な検証を行ってからにするのが賢明です。

モデルサイズ選択の罠

4つのモデルが選べることは強みですが、逆に「どれを選べばいいかわからない」という選択コストも発生します。実務上の推奨としては、まずE4BまたはOllamaのデフォルトで試し、性能が足りなければ26B MoEにステップアップするのが最も効率的です。いきなり31Bを選ぶとハードウェア要件でつまずく可能性があります。

また、オープンモデルの世界は進化のスピードが非常に速いです。今日のベストプラクティスが3ヶ月後には変わっている可能性は十分にあります。Gemma 4をプロダクションに組み込む際は、モデルの差し替えが容易なアーキテクチャ(抽象化レイヤーを設けてモデル依存を最小化する設計)にしておくことを強くおすすめします。特定のモデルに強く依存するコードを書いてしまうと、次の世代への移行コストが跳ね上がります。

筆者の見解 — Gemma 4が変えるオープンモデルの地図

AI Labの運営者として、日々さまざまなAIモデルを検証している立場から、Gemma 4について率直な見解を述べます。結論から言えば、Gemma 4は「オープンモデルがクローズドモデルに匹敵する時代の幕開け」を象徴するリリースです。

まず、Apache 2.0への転換は「Googleの本気」の表れだと考えています。独自ライセンスを捨ててApache 2.0に移行するということは、Gemmaをエコシステムの中心に据える長期戦略の意思表示です。Googleが「自社のAI技術を囲い込む」のではなく「開放して仲間を増やす」方向に舵を切ったことは、AI業界全体にとって歓迎すべき動きです。

実際、Gemma 4はGemini Nano 4の基盤として2026年後半にデバイスへ搭載される予定であり、「まずオープンモデルで開発者を巻き込み、その成果をGeminiエコシステムに還元する」という循環が見えてきます。Androidの成功と同じ構図——OSをオープンソースにして端末メーカーを巻き込み、エコシステム全体で競合に対抗する——をAIモデルでも再現しようとしているのでしょう。

次に、26B MoE(A4B)の存在がゲームチェンジャーです。有効パラメータわずか3.8Bで31B Denseの97%の性能。これは何を意味するかというと、RTX 3090やM2 Pro程度のハードウェアで、クローズドモデルに肉薄する性能のAIを自社サーバーで動かせるということです。これまで「ローカルLLMは性能が足りない」と敬遠していた企業にとって、状況は大きく変わります。

そして、日本語性能の高さは日本の開発者・企業にとって特に注目に値します。JCommonsenseQA 97.9%という数字は、日本語タスクでの信頼性がかなりの水準に達していることを示しています。社内チャットボットやRAGシステムの基盤として、十分に実用レベルです。

もちろん、課題がないわけではありません。ツールチェーンの成熟度、MoEの推論速度、Thinking Modeの日本語問題など、本番採用前に検証すべき点は残っています。しかし、ライセンスの自由度、性能、効率性、マルチモーダル対応を総合すると、2026年4月時点でオープンモデルの最有力候補であることは間違いありません。

オープンモデル三国志——Gemma、Llama、Qwen。この3つの勢力がしのぎを削る中で、ライセンスの透明性と効率性でGemma 4が一歩リードしていると筆者は見ています。今後3〜6ヶ月でGemma 4ベースのファインチューニングモデルが大量に登場するでしょう。その波に乗るかどうかは、今このモデルに触れておくかどうかにかかっています。

最後に、Gemmaの進化の速さにも触れておきたいと思います。Gemma 1が2024年2月に登場してから2年で、2B/7Bの基本モデルから、マルチモーダル・MoE・256Kコンテキスト・Apache 2.0のGemma 4に到達しました。Gemma 2(2024年6月)、Gemma 3(2025年3月)と約1年間隔でメジャーバージョンが出ており、次世代のGemma 5がどこまで進化するかも注目です。Gemmaシリーズの累計ダウンロード数は4億回を超え、10万以上の派生モデルが生まれているエコシステムの規模を考えると、今Gemma 4に投資する価値は十分にあるでしょう。

よくある質問

Q. Gemma 4は商用利用できますか?

はい、Apache 2.0ライセンスで完全に商用利用可能です。Gemma 3までの独自ライセンスとは大きく異なり、改変・再配布・派生モデルの販売もすべて制限なく行えます。ソースコード公開義務もないため、企業が自社サービスの一部として組み込んでもライセンス上の問題は一切ありません。LinuxカーネルやKubernetesと同じライセンスです。

Q. Gemma 4を自分のPCで動かすには何が必要ですか?

最小のE2Bモデルなら約5GBのVRAM(4bit量子化時)���動作し、驚くべきことにRaspberry Pi 5でも実行可能です。E4Bは約6GBで一般的なゲーミングPCで快適に動き、26B MoEは約18GB、31Bは約20GBが目安です。Ollamaをインストールすればollama run gemma4のたった1コマンドで今すぐ始められます。Apple SiliconのMacではMLX最適化版も利用できるため、Macユーザーにも手軽です。

Q. Gemma 4の日本語性能はどの程度ですか?

31BモデルはJCommonsenseQA v1.1で97.9%を記録しています。35以上の言語をネイティブサポートしており、日本語はその中に含まれます。ただし、Thinking Mode使用時に日本語のMCQ(多肢選択)タスクで性能が低下する報告があるため、用途に応じてモードを切り替えることをおすすめします。

Q. Gemma 4とLlama 4はどちらが企業利用に向いていますか?

ライセンスの自由度ではGemma 4(Apache 2.0)が大きく優位です。Llama 4のCommunity LicenseはMAU 7億人超で個別契約が必要です。性能面でも、Gemma 4 31BはLlama 4 Scout(109B)をGPQA Diamondで約10ポイント上回りつつ、パラメータ数は約3分の1と効率的です。ただし、Llama 4は10Mトークンの超長コンテキストに対応しており、大量文書処理には利点があります。

参照元

- Google DeepMind — Introducing Gemma 4(公式発表)

- Google AI — Gemma 4 Model Card

- Hugging Face — Welcome Gemma 4

- Ollama — Gemma 4

- DevelopersIO — Gemma 4日本語ベンチマーク検証

- Interconnects — Gemma 4 and What Makes an Open Model

- Let’s Data Science — Gemma 4 Community Findings

- AI.rs — Gemma 4 vs Qwen 3.5 vs Llama 4 Compared

- LMArena(Chatbot Arena)— AI Model Leaderboard

- Google Open Source Blog — Gemma 4: Expanding with Apache 2.0

- Google AI Studio — Gemma on Gemini API