GPT-5.4 mini/nanoを徹底解説|無料で最新AIが使える時代に

2026年3月17日、OpenAIがGPT-5.4 miniとGPT-5.4 nanoをリリースしました。これは単なるモデルの追加ではありません。最新のフラッグシップに迫る性能を持つminiが、無料ユーザーでも「Thinking」機能を通じて利用可能になったのです。さらに、nanoはAPI入力わずか$0.20/100万トークンという圧倒的な低価格で、データ分類や抽出タスクに特化した新カテゴリのモデルです。

つい先日までの常識は「最新AIを使いたければ有料プランが必須」でした。しかし、GPT-5.4 miniの無料開放によって、その壁が崩れ始めています。一方のnanoは、開発者にとって「コストが理由でAIを組み込めなかった」シーンを一気に解決する存在です。

この記事では、GPT-5.4 miniとnanoの性能・料金・使い方を、GPT-5.4フラッグシップの解説記事とは異なる角度から徹底的に掘り下げます。「自分にはどちらが合うのか」「既存の競合モデルと比べてどうなのか」──この記事を読み終えるころには、明確な答えが見つかるはずです。

1. GPT-5.4 mini/nanoとは?全体像を30秒で把握

GPT-5.4 miniとnanoは、OpenAIが2026年3月17日にリリースしたGPT-5.4ファミリーの小型モデルです。フラッグシップのGPT-5.4をベースに、コスト効率と特定ユースケースへの最適化を追求して設計されています。イメージとしては、同じエンジン設計思想を持つ高級セダンとコンパクトカーのような関係です。従来の「miniモデル」は性能面で妥協が大きかったのですが、GPT-5.4世代では状況が大きく変わりました。

ひと言でまとめると、こうなります。

- GPT-5.4 mini:フラッグシップの約9割の性能を、約3分の1の価格で実現。ChatGPTの無料ユーザーでもThinking機能経由で利用可能

- GPT-5.4 nano:超低コスト(フラッグシップの12分の1の価格)で、データ分類・抽出・ランキングなどの軽量タスクに特化。API専用モデル

GPT-5.4ファミリー全体を階層的に見ると、以下のようになります。

Proは最高性能だがコストも最高(入力$15.00/MTok)、標準版はバランス型($2.50/MTok)、miniは高コスパ($0.75/MTok)、nanoは極限のコスト効率($0.20/MTok)。「性能とコストのどこにフォーカスするか」で、同じGPT-5.4ファミリー内でも選択肢が分かれる設計です。

では、miniとnanoのそれぞれについて、性能・料金・使い方を詳しく見ていきましょう。

2. GPT-5.4 miniの性能と特徴──フラッグシップに迫る実力

基本スペック

GPT-5.4 miniは、名前に「mini」と付いていますが、その性能はフラッグシップのGPT-5.4に驚くほど近い水準です。

| 項目 | GPT-5.4 mini | GPT-5.4(フル) |

|---|---|---|

| コンテキストウィンドウ | 400,000トークン | 1,048,576トークン |

| 最大出力 | 128,000トークン | 128,000トークン |

| API入力価格 | $0.75/MTok | $2.50/MTok |

| API出力価格 | $4.50/MTok | $15.00/MTok |

| 画像入力 | 対応 | 対応 |

| Web検索 | 対応 | 対応 |

| コードインタプリタ | 対応 | 対応 |

| 画像生成 | 対応 | 対応 |

| コンピュータ使用 | 対応 | 対応 |

注目すべきは、コンテキストウィンドウ以外の機能面ではフラッグシップとほぼ同等という点です。Web検索、コードインタプリタ、画像生成、さらにはコンピュータ使用(PCの画面操作を自動化する機能)まで、すべて利用できます。コンテキストウィンドウこそ40万トークン(フラッグシップの約38%)ですが、一般的なユースケースでは十分すぎる容量です。

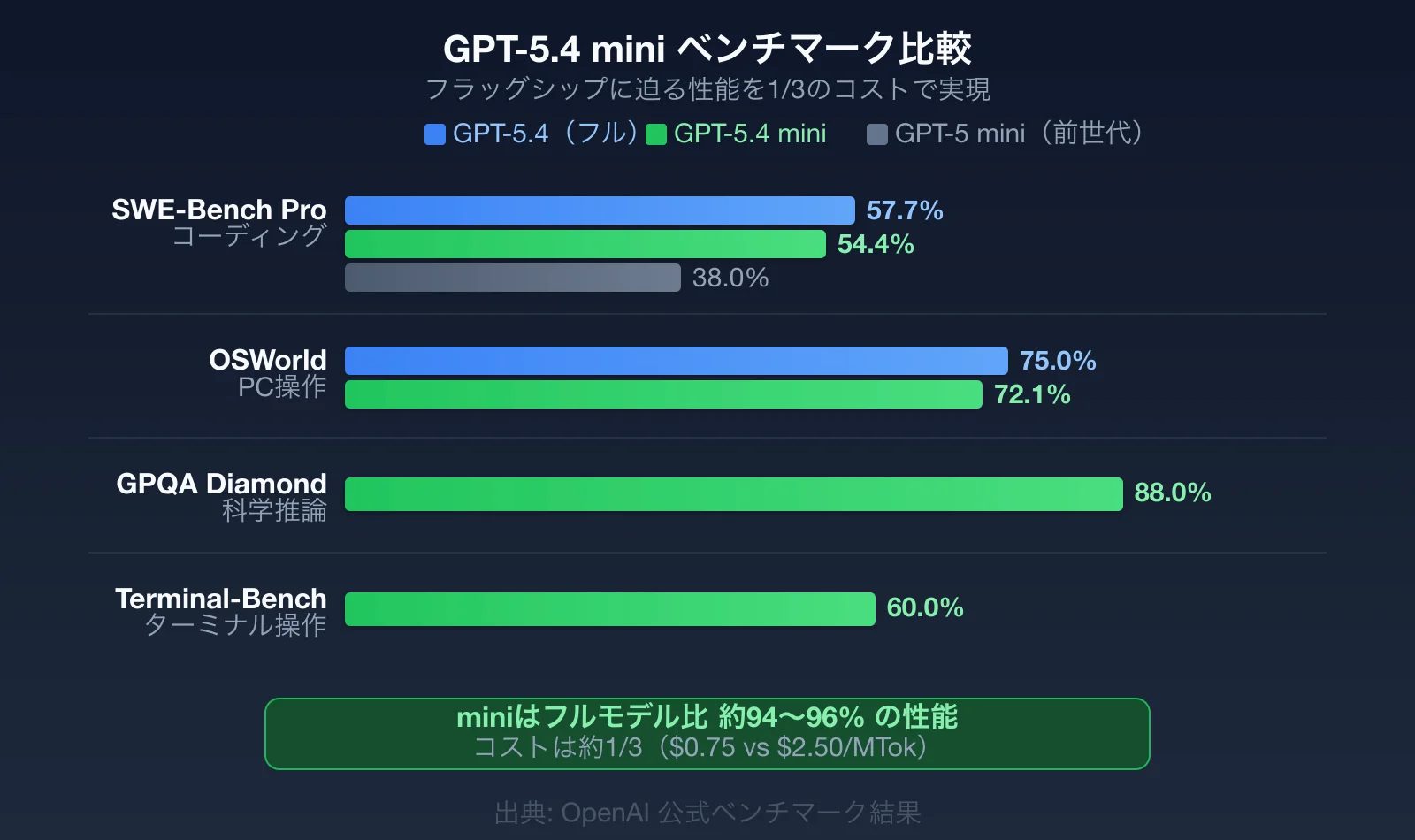

ベンチマーク──数字が証明する実力

「miniだから性能は落ちる」──そう思うのは当然です。しかし、実際のベンチマーク結果を見ると、その差は想像以上に小さいことがわかります。

| ベンチマーク | GPT-5.4 mini | GPT-5.4(フル) | 差分 |

|---|---|---|---|

| SWE-Bench Pro(コーディング) | 54.4% | 57.7% | -3.3pt |

| OSWorld-Verified(PC操作) | 72.1% | 75.0% | -2.9pt |

| Terminal-Bench 2.0(ターミナル操作) | 60.0% | ── | ── |

| GPQA Diamond(科学推論) | 88.0% | ── | ── |

| Toolathlon(ツール使用) | 42.9% | 54.6% | -11.7pt |

SWE-Bench Pro(実際のソフトウェアバグ修正タスク)では、フラッグシップとの差はわずか3.3ポイント。OSWorld(PCの画面を操作してタスクを完了するベンチマーク)でも2.9ポイント差です。フラッグシップの3分の1の価格で、9割以上の性能が手に入る──これがminiの本質です。

ただし、Toolathlon(複数のツールを組み合わせて複雑なタスクを遂行するベンチマーク)では11.7ポイントの差があります。極めて複雑なツール連携が必要なタスクでは、フラッグシップを選ぶ価値があるでしょう。

これらのベンチマーク結果をどう解釈すべきか。SWE-Bench Proは実際のGitHubリポジトリからのバグ修正タスクで構成されており、プロのソフトウェアエンジニアにとっても難しい問題が含まれています。ここでフラッグシップと3.3ポイントしか差がないということは、日常的なコーディング作業ではminiとフラッグシップの違いを体感するのは難しいことを意味します。OSWorldも同様で、PCの画面操作を自動化するタスクにおいて、miniは十分に実用的な精度を持っています。

対応ツールの充実度

GPT-5.4 miniは、OpenAIのAPIドキュメントによると、以下のツールに対応しています。

- Web検索:リアルタイムの情報取得

- ファイル検索:アップロードしたドキュメントの検索・分析

- コードインタプリタ:Pythonコードの実行・データ分析

- 画像生成:GPT-5.4ベースの画像作成

- コンピュータ使用:PCの画面操作を自動化

- MCP(Model Context Protocol):外部ツールとの連携プロトコル

この充実度は、フラッグシップとまったく同じです。「miniだから使えないツールがある」ということは基本的にありません。MCP(Model Context Protocol)にも対応しているため、外部のデータベースやAPIと連携するカスタムツールを構築することも可能です。開発者にとっては、miniに移行してもアーキテクチャを変更する必要がない点が大きなメリットです。

3. 無料・Goユーザーも使えるThinking機能の使い方

今回のリリースで最もインパクトが大きいのは、ChatGPTの無料ユーザーとGoプラン(月額約1,200円)ユーザーがGPT-5.4 miniをThinking機能経由で利用できるようになったことです。

Thinking機能とは何か

Thinking機能は、AIが回答する前に「考える時間」を取る仕組みです。ちょうど数学のテストで「すぐ解答を書く」のではなく「余白に計算過程を書いてから答える」のと同じようなイメージです。通常の回答よりも時間はかかりますが、推論の精度が大幅に向上します。数学の証明、論理パズル、複雑なコードのデバッグなど、じっくり考えることで正答率が上がるタスクで特に効果を発揮します。

これまで、ChatGPTのThinking機能はPlus以上のプラン(月額約3,000円〜)でしか使えませんでした。GPT-5.4 miniのリリースにより、この制限が撤廃されたのです。

使い方の手順

ChatGPTでGPT-5.4 miniのThinking機能を使う手順は簡単です。

- ChatGPTにアクセスしてログイン(アカウントがなければ無料で作成)

- メッセージ入力欄の左にある「+」ボタンをタップまたはクリック

- メニューから「Thinking」を選択

- 通常通りプロンプト(質問や指示)を入力して送信

これだけで、GPT-5.4 miniのThinking機能が動作します。AIが考えている過程が表示されるため、どのようなロジックで回答を導いているかも確認できます。

利用制限について

無料ユーザーには利用回数の制限があります。OpenAIのヘルプページによると、5時間あたりのメッセージ数に上限が設定されています。具体的な回数はモデルや負荷状況によって変動しますが、「ちょっと試してみたい」という用途には十分な回数が提供されています。

Goプラン(月額約1,200円)にアップグレードすると、制限が大幅に緩和されます。日常的にThinking機能を使いたい場合は、Goプランが現時点でのコストパフォーマンス最強の選択肢です。Goプランは以前は存在しなかった価格帯で、Freeプランでは物足りないがPlusプラン(約3,000円)は高いと感じるユーザーの「ちょうどいい」ポジションを埋めています。

なお、Plus以上のプラン(月額約3,000円〜)ではフラッグシップのGPT-5.4 Thinkingが利用可能です。miniとフラッグシップのThinkingの違いは、前述のベンチマーク差がそのまま反映されます。日常利用ならminiで十分、プロフェッショナルな開発やリサーチにはフラッグシップ──という使い分けが合理的です。

重要なのは、「無料だから品質が低い」わけではないという点です。GPT-5.4 miniのThinkingは、数ヶ月前のフラッグシップモデルを上回る性能を持っています。無料ユーザーが手にしているのは「おまけ」ではなく、実用的な最新AIなのです。

実際に使ってみると、その実力がよくわかります。たとえば「この文章を英語に翻訳して、ビジネスメールにふさわしいトーンにして」といった日常的なリクエストでは、miniのThinkingとフラッグシップのThinkingの違いを見分けるのは困難です。数学の証明やコードのデバッグでも、miniは十分に実用的な回答を返します。違いが出るのは、極めて長い文脈(40万トークンを超える入力)や、複数ツールの高度な連携が必要なケースに限られます。

4. GPT-5.4 nanoの性能と特徴──超低コストの新領域

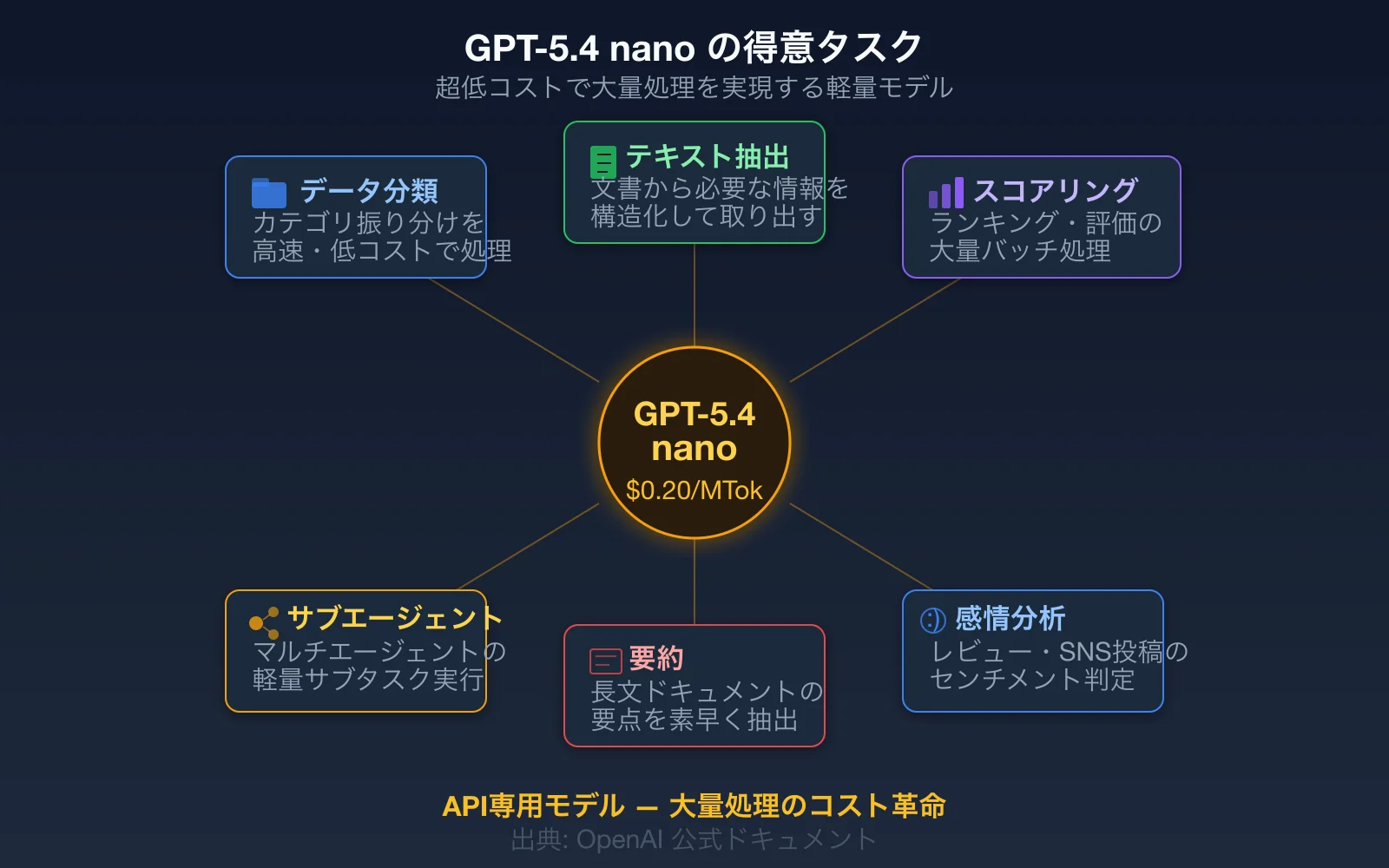

GPT-5.4 nanoは、miniとはまったく異なるコンセプトで設計されたモデルです。汎用的な会話ではなく、特定の軽量タスクを圧倒的な低コストで大量に処理することに特化しています。

nanoの設計思想

なぜ「nano」が必要なのか。それは、AIを使ったシステム開発において「1回あたりのコストが数セントでも、100万回実行すれば大きな負担になる」という現実があるからです。

たとえば、ECサイトの商品レビュー10万件をポジティブ/ネガティブに分類したいとします。フラッグシップのGPT-5.4で処理すれば高精度ですが、コストは膨大です。nanoなら、フラッグシップの12分の1のコストで実用的な精度の分類が可能になります。

得意分野と具体的なユースケース

nanoが最も力を発揮するのは、以下のような「軽いが大量」のタスクです。

- データ分類:テキストのカテゴリ分け、スパム判定、意図(インテント)の識別

- 情報抽出:非構造化テキストから名前・住所・日付・金額などを取り出す

- ランキング/スコアリング:検索結果の関連性スコア付け、推薦システムの候補絞り込み

- 要約:長文の段落を1〜2文に要約する

- 感情分析:レビューやSNS投稿の感情をポジティブ/ネガティブ/ニュートラルに判定

- サブエージェント:マルチエージェントシステムのサブタスク実行

最後の「サブエージェント」は特に注目です。AIエージェントが複雑なタスクを実行する際、すべてのステップをフラッグシップで処理する必要はありません。「この部分は単純な分類だからnanoに任せる」「ここは推論が必要だからminiを使う」というモデルの使い分け(ルーティング)が、nanoの登場によってコスト面で現実的になりました。

nanoのスペックと制限事項

| 項目 | GPT-5.4 nano |

|---|---|

| API入力価格 | $0.20/MTok |

| API出力価格 | $0.80/MTok |

| 画像入力 | 対応 |

| Web検索 | 対応 |

| ファイル検索 | 対応 |

| コードインタプリタ | 対応 |

| 画像生成 | 対応 |

| コンピュータ使用 | 非対応 |

| ツール検索 | 非対応 |

| ChatGPTでの利用 | 不可(API専用) |

| ファインチューニング | 非対応 |

注意すべきは3つの制限です。まず、ChatGPTでは利用できません。APIを通じてのみアクセス可能なため、開発者向けのモデルです。次に、コンピュータ使用(PC画面操作の自動化)には非対応です。そして、ツール検索(利用可能なツールを自動的に見つけて選択する機能)も非対応です。

これらの制限は、nanoの設計思想を考えれば納得がいきます。nanoは「考えて判断する」モデルではなく、「決められたタスクを高速・低コストでこなす」モデルです。たとえるなら、miniが「何でもこなせる正社員」だとすれば、nanoは「特定業務に特化した高速の仕分けロボット」に相当します。複雑な判断が必要なタスクにはminiやフラッグシップを使い、nanoはシンプルなタスクに集中させる──この使い分けが前提です。ファインチューニング(追加学習による特化)にも現時点では非対応ですが、そもそもnanoの得意分野ではプロンプトエンジニアリングだけで十分な精度が出るケースが大半です。

ベンチマーク──小さくても侮れない性能

nanoのSWE-Bench Proスコアは52.4%です。これは「mini(54.4%)に近い」だけでなく、前世代のフラッグシップであるGPT-5 miniを上回る水準でもあります。最大推論努力(reasoning effort)を設定した場合、nanoはGPT-5 miniを超える性能を発揮するとOpenAIは公式ブログで述べています。

つまり、nanoは「安かろう悪かろう」ではありません。前世代のフラッグシップクラスの性能を、桁違いの低コストで利用できるモデルなのです。

開発者にとって特に重要なのは、nanoが推論努力(reasoning effort)のパラメータを受け付ける点です。推論努力を「高」に設定すると、処理時間は長くなりますがより正確な結果が得られます。「低」に設定すると高速・低コストで応答します。つまり、同じnanoモデルでも「精度重視」と「速度・コスト重視」を1つのAPIパラメータで切り替えられるのです。大量の分類タスクでは低推論努力で高速処理し、判断が微妙なケースだけ高推論努力で再処理する──このような二段階パイプラインも、nanoなら低コストで構築できます。

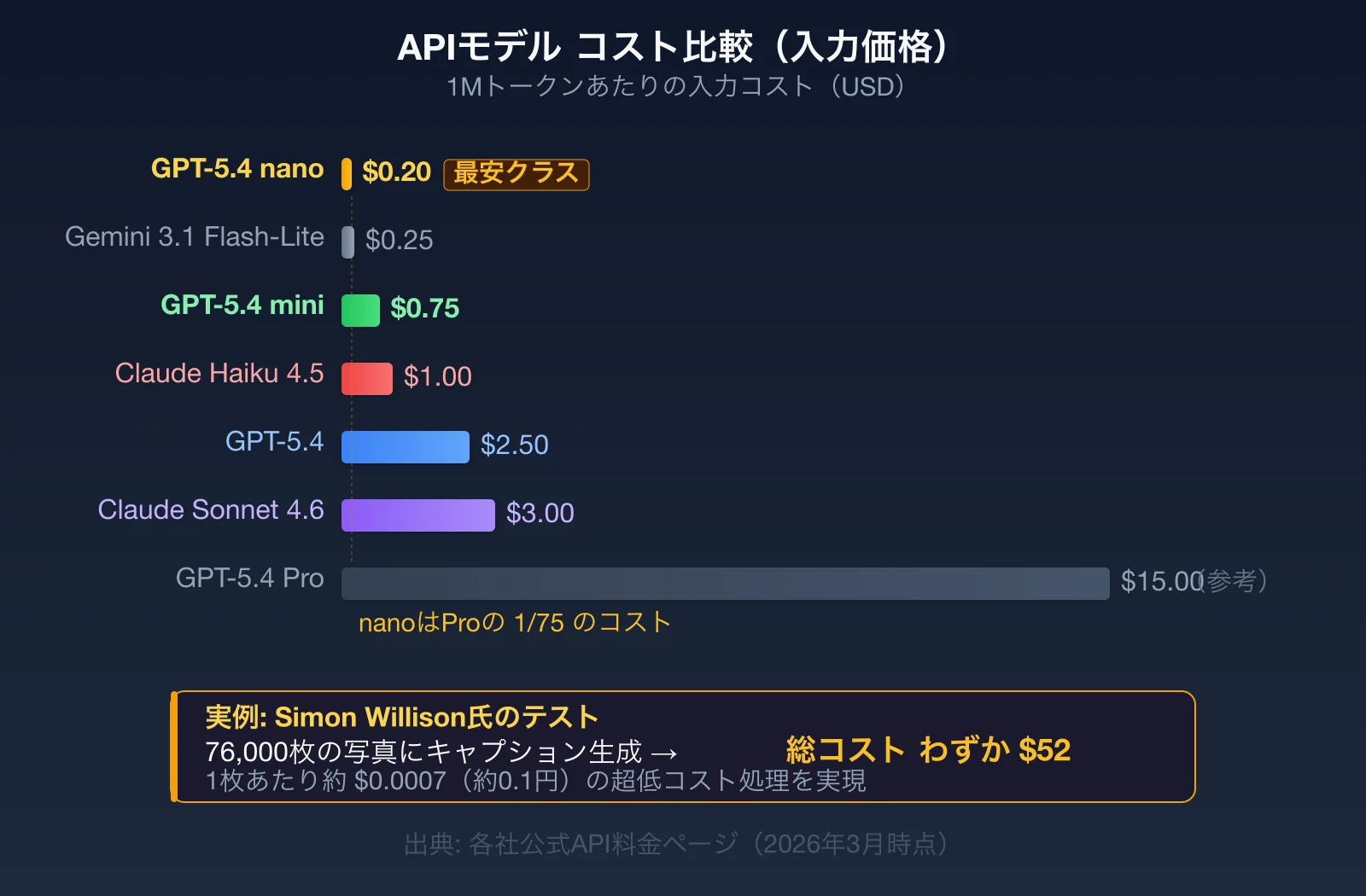

5. 料金比較──どれだけ安いのか

miniとnanoの価格競争力を実感するために、主要モデルのAPI入力価格を一覧で比較してみましょう。

| モデル | 入力価格 | 出力価格 | 対nanoコスト比 |

|---|---|---|---|

| GPT-5.4 nano | $0.20 | $0.80 | 1倍(基準) |

| Gemini 3.1 Flash-Lite | $0.25 | $1.50 | 1.25倍 |

| GPT-5.4 mini | $0.75 | $4.50 | 3.75倍 |

| Claude Haiku 4.5 | $1.00 | $5.00 | 5倍 |

| GPT-5.4(フル) | $2.50 | $15.00 | 12.5倍 |

| Claude Sonnet 4.6 | $3.00 | $15.00 | 15倍 |

| GPT-5.4 Pro | $15.00 | $60.00 | 75倍 |

※価格は100万トークンあたり(/MTok)。2026年3月時点のOpenAI API Pricing、Anthropic Pricing、Google AI Pricingに基づく。

Batch APIでさらに50%オフ

OpenAIのBatch APIを使うと、上記の価格からさらに50%割引になります。Batch APIは、リアルタイムの応答が不要なタスク(24時間以内に結果が返る)に利用できる仕組みです。

たとえば、GPT-5.4 nanoをBatch APIで使うと、入力価格は$0.10/MTok。10万件のテキスト分類を一晩で処理するようなバッチジョブには最適です。リアルタイムの応答が不要な夜間のデータ処理、週次の分析レポート生成、大規模なデータクリーニングなど、Batch APIが活きるシーンは多岐にわたります。

実例:76,000枚の写真を$52で処理

GPT-5.4 miniの低コストぶりを示す印象的な実例があります。プログラマーでありAIライターのSimon Willison氏は、自身の76,000枚の写真にGPT-5.4 miniで説明文を付けるプロジェクトを実施し、総コストわずか$52(約7,800円)で完了したと報告しています。

フラッグシップのGPT-5.4で同じ処理を行えば、コストは約3.3倍の$172前後。1枚あたりの品質差はわずかでも、76,000枚の規模になるとコスト差は歴然です。「miniで十分な品質が出るなら、圧倒的にminiが合理的」──これが大量処理における鉄則です。

さらに、Batch APIを使えばこの$52がさらに半額の$26程度になります。76,000枚の写真に説明文を付けるプロジェクトが約3,900円で完了する計算です。個人プロジェクトでも十分に手が届くコスト感ではないでしょうか。

6. GPT-5.1引退──モデル世代交代の加速

GPT-5.4 mini/nanoのリリースと前後して、GPT-5.1は2026年3月11日にChatGPTから引退しました。GPT-5.1 Instant、GPT-5.1 Thinking、GPT-5.1 Proのすべてがサービスから外れています。

OpenAIのヘルプページによると、既存の会話は以下のように自動移行されました。

- GPT-5.1 Instant → GPT-5.3 Instant

- GPT-5.1 Thinking → GPT-5.4 Thinking

- GPT-5.1 Pro → GPT-5.4 Pro

なお、APIからの引退は現時点では未定です。OpenAIのDeprecationsページにもGPT-5.1のAPI引退日は記載されておらず、引退時には事前に通知するとOpenAIは表明しています。APIでGPT-5.1を使い続けているシステムはすぐに停止する必要はありませんが、早めの移行計画を立てておくことが賢明です。過去のモデル引退パターンを見ると、ChatGPTからの引退後、数ヶ月〜半年程度でAPIからも引退するケースが多いため、余裕を持った計画が重要です。

「去年のフラッグシップが翌年の無料枠」現象

この流れをマクロで見ると、興味深いトレンドが浮かび上がります。かつてのフラッグシップモデルの性能が、数ヶ月後には小型モデルや無料枠で利用可能になるというサイクルです。

GPT-5.1がリリースされた当時、その性能はAI業界の最先端でした。しかし今、GPT-5.4 nanoのSWE-Bench Proスコア(52.4%)はGPT-5 miniを上回り、GPT-5.4 miniは無料ユーザーに開放されています。AI業界の「性能の民主化」は、私たちの予想をはるかに超えるスピードで進んでいるのです。

これは開発者にとっても一般ユーザーにとっても朗報です。「今の最高性能に高い料金を払うか、数ヶ月待って無料や低コストで同等の性能を使うか」という選択肢が生まれているからです。もちろん、最先端の性能がビジネス上の差別化に直結するケースでは、最新フラッグシップへの投資は十分にペイします。しかし、多くのタスクでは「数ヶ月前のフラッグシップ」で十分なのです。重要なのは、自分のユースケースに必要な性能レベルを正しく見極め、コストと品質のバランスが取れたモデルを選ぶことです。

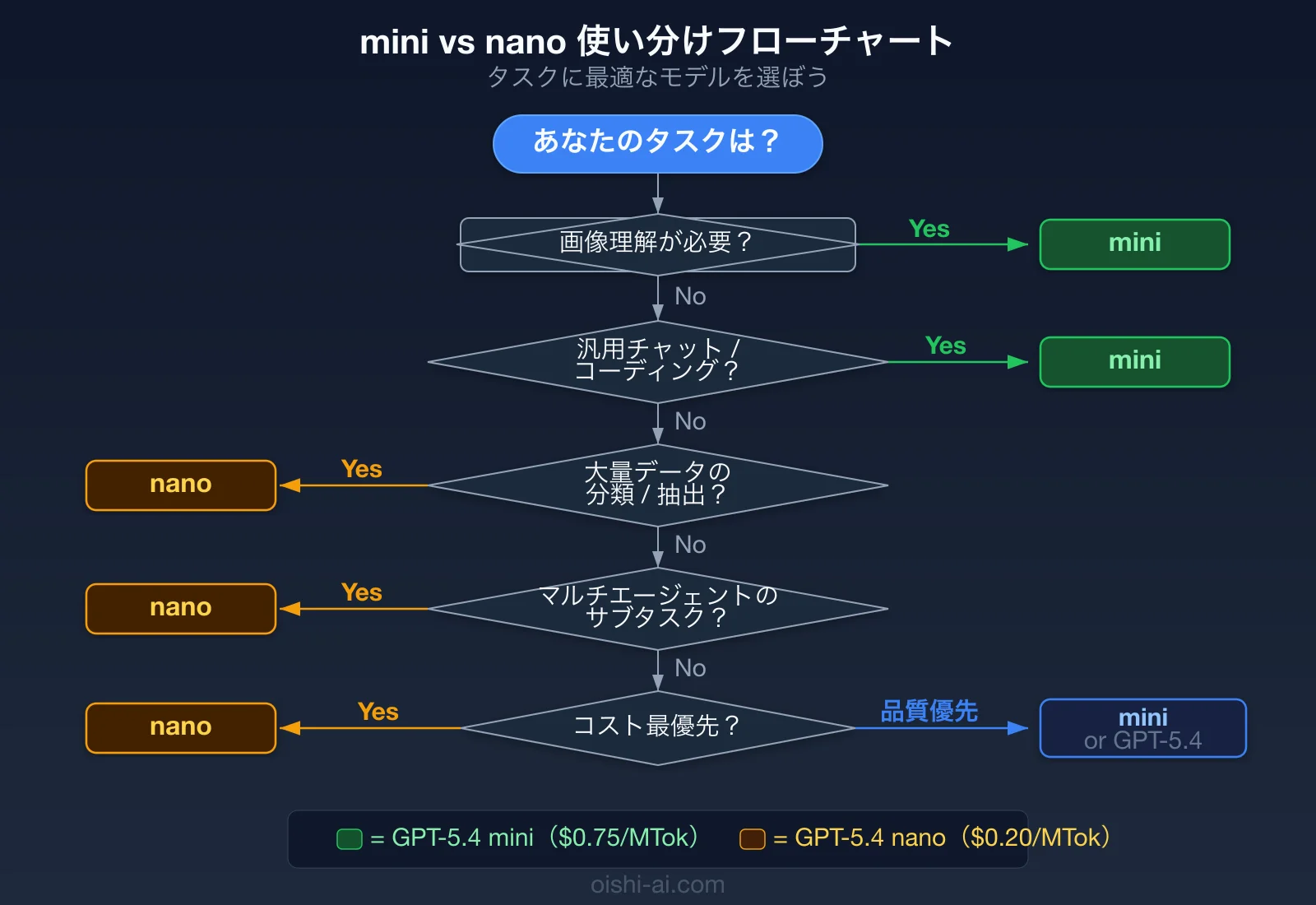

7. 開発者向け実践ガイド──miniとnanoの使い分け

「miniとnano、どちらを使えばいいのか?」──開発者が最も知りたいのはこのポイントでしょう。判断基準はシンプルです。

miniが向いているケース

- 汎用的なチャットボット:顧客対応、社内FAQ、カスタマーサポート

- コーディング支援:コードレビュー、バグ修正、リファクタリング提案

- コンテンツ生成:記事の下書き、メール文の作成、レポートの要約

- 画像理解:アップロードされた画像の分析・説明

- 中程度の推論:質問回答、データ分析、意思決定サポート

一般的なAIアプリケーションの大半はminiでカバーできます。フラッグシップとの性能差が3ポイント以内のタスクが多いため、コストを3分の1に抑えながらほぼ同じユーザー体験を提供できるのが最大のメリットです。特に、GitHub CopilotでもGPT-5.4 miniが採用されており、コーディング支援の現場での実績も積み上がっています。

nanoが向いているケース

- 大量のデータ分類:メール振り分け、チケット分類、商品カテゴリ判定

- 情報抽出パイプライン:請求書からの金額抽出、契約書からの条項抽出

- リアルタイムフィルタリング:コメントのモデレーション、スパム検出

- マルチエージェントのサブタスク:メインエージェントの判断を補助する軽量タスク

- A/Bテスト用の評価:大量のレスポンスを自動スコアリング

nanoの真価は「1件あたりのコストが極めて低い」ことにあります。1件の処理だけ見ればminiとの差は微々たるものですが、10万件、100万件というスケールになると、コスト差は数百ドル〜数千ドルに膨れ上がるのです。また、nanoの応答速度はminiよりも高速なため、リアルタイム処理が求められるアプリケーション(チャットの即時フィルタリング、ストリーミングデータの分類など)でも強みを発揮します。

判断の基本ルール

迷ったときは、次の3つの質問で判断できます。

- タスクは「考える」必要があるか? → Yes: mini / No: nano

- 処理件数は1,000件を超えるか? → Yes: nanoを検討 / No: miniで十分

- コンピュータ使用やツール検索が必要か? → Yes: mini(nanoは非対応)

もちろん、両方を組み合わせるのが実践的な最適解です。たとえば、カスタマーサポートシステムでは「問い合わせの分類」をnanoで行い、「回答の生成」をminiで行う。こうすることで、全体のコストを抑えつつ、ユーザーに接する部分の品質を維持できます。

コスト試算の具体例

実際の数字で考えてみましょう。月間10万件の顧客問い合わせを処理するカスタマーサポートシステムを想定します。

パターンA:すべてminiで処理

- 分類+回答生成をすべてGPT-5.4 miniで実行

- 1件あたり平均入力500トークン+出力1,000トークン

- 月間コスト:入力$37.5 + 出力$450 = 約$487.5(約73,000円)

パターンB:nano+miniのハイブリッド

- 分類(nano):1件あたり入力300トークン × 10万件 → 入力$6

- 回答生成(mini):1件あたり入力400トークン+出力1,000トークン × 10万件 → 入力$30 + 出力$450

- 月間コスト:約$486(約73,000円)

この例ではコスト差は小さいですが、分類の精度が向上する効果が得られます。nanoで「技術的な問い合わせ」「料金に関する問い合わせ」「クレーム」と正確に分類し、それぞれに最適化されたプロンプトでminiが回答する。結果として、回答の品質が上がりながらコストは据え置きです。

分類の比率が高い(例:10段階の詳細分類+ルーティング)ケースや、処理件数が100万件を超えるスケールでは、nanoによるコスト削減効果はさらに大きくなります。

8. 競合モデルとの立ち位置──Claude・Geminiとの比較

GPT-5.4 miniとnanoは、OpenAI内でのラインナップ整備にとどまらず、他社の競合モデルに対しても明確なポジショニングを示しています。ChatGPT vs Claude vs Gemini比較記事で解説したフラッグシップ同士の競争に加えて、小型モデル市場でも熾烈な争いが繰り広げられています。

小型モデル同士の比較

| モデル | 入力価格 | 出力価格 | 主な強み |

|---|---|---|---|

| GPT-5.4 nano | $0.20 | $0.80 | 最安値級、分類・抽出特化 |

| Gemini 3.1 Flash-Lite | $0.25 | $1.50 | Googleエコシステム統合 |

| GPT-5.4 mini | $0.75 | $4.50 | 高性能+全ツール対応 |

| Claude Haiku 4.5 | $1.00 | $5.00 | 安全性重視、日本語品質 |

価格面では、GPT-5.4 nanoが最安値、次いでGemini 3.1 Flash-Liteという構図です。ただし、価格だけでモデルを選ぶべきではありません。

各社の戦略の違い

OpenAI、Anthropic、Googleの3社は、小型モデルの位置づけが異なります。

OpenAI(mini/nano)は「フラッグシップの性能をスケールダウンしてコストを下げる」アプローチです。miniはフラッグシップの9割の性能を3分の1の価格で提供し、nanoは特定タスクに絞ることでさらにコストを圧縮しています。ラインナップの幅広さが特徴です。

Anthropic(Claude Haiku 4.5)は、安全性と指示追従性に重点を置いた小型モデルです。価格面ではGPT-5.4 miniより33%高いですが、Anthropicの強みである「指示に忠実に従う」「安全なレスポンスを返す」という特性は小型モデルでも維持されています。特に日本語の自然さには定評があります。

Google(Gemini 3.1 Flash-Lite)は、Google検索やGoogle Workspaceとのネイティブ統合が強みです。すでにGoogleのエコシステムを活用している企業にとっては、APIの呼び出し先を変えるだけで導入できる手軽さがあります。

選び方の指針

結論として、小型モデルの選択は「何を優先するか」で決まります。

- コスト最優先:GPT-5.4 nano(最安値)またはGemini Flash-Lite(次点)

- 性能とコストのバランス:GPT-5.4 mini(フラッグシップ9割の性能)

- 安全性・日本語品質:Claude Haiku 4.5

- Googleエコシステム統合:Gemini Flash-Lite

なお、実際のプロダクション環境では「試してから決める」が鉄則です。ベンチマークスコアは参考になりますが、自社のデータと自社のタスクで比較評価を行うことに勝る判断材料はありません。多くのAPIは無料クレジットや低コストのトライアルを提供しているので、まずは自分のユースケースで動かしてみることを強くお勧めします。

特に注意したいのは、小型モデルの得意分野は各社で異なる点です。たとえば、日本語の自然な文章生成ではClaude Haiku 4.5が高い評価を受けていますが、英語のコーディングタスクではGPT-5.4 miniが強い傾向があります。Gemini Flash-Liteは、Google検索のリアルタイムデータへのアクセスが他社にないアドバンテージです。自社の主要言語、主要タスク、統合先のエコシステムを軸に、2〜3モデルの比較テストを行うのが理想的です。

9. 最新AIが無料で使える意義──AI民主化の現在地

ここまで性能と料金の話を中心にしてきましたが、今回のリリースには技術面を超えた大きな意義があります。それは「最新AIへのアクセス格差」が急速に縮まっているという事実です。

1年前との比較で見える変化

わずか1年前を思い出してみてください。当時の最新フラッグシップを使うには、月額数千円のサブスクリプションが必須でした。企業がAPI経由で大量に利用する場合は、月額数万〜数十万円のコストを覚悟する必要がありました。

今、GPT-5.4 miniという「フラッグシップの9割の性能を持つモデル」が、無料アカウントで使えるようになっています。API経由でも、入力100万トークンあたり$0.75。nanoなら$0.20です。

この変化のスピードは、AI業界にいる人間でさえ驚くレベルです。まるでムーアの法則(半導体の集積度が約2年で倍増する)が加速版にアップグレードされたかのように、AIの「性能あたりのコスト」が下がっています。

具体的な時系列で振り返ると、その加速度がよくわかります。GPT-4oがリリースされたのは2024年5月。当時のAPI価格は入力$5.00/MTokenで、これでも「安くなった」と話題になりました。GPT-5.4 nanoの$0.20/MTokenは、わずか2年足らずでAPI価格が25分の1に下がったことを意味します。出力価格も同様の下落カーブを描いています。

誰にとってのチャンスか

AI民主化の恩恵は、大きく3つのグループに広がっています。

個人ユーザーにとっては、「お金をかけずに最先端のAIを試せる」環境が整いました。学生がレポートの推敲にThinking機能を使う。フリーランスが企画書のブレインストーミングにAIを活用する。これらが月額ゼロ円で可能になったのです。

スタートアップや中小企業の開発者にとっては、nanoの登場がゲームチェンジャーです。これまで「AIを組み込みたいが、API費用が事業計画に合わない」と断念していたプロダクトが、nanoのコスト構造なら成立する可能性があります。月間100万リクエストのアプリでも、入力コストは$200程度。ビジネスとして成立する数字です。

教育機関や非営利団体にとっても、アクセス障壁の低下は重要です。予算の制約が厳しい組織でも、最新AIの恩恵を受けられるようになります。途上国の研究者や教育者が、先進国の大企業と同じ品質のAIツールにアクセスできる。これはテクノロジーの歴史の中でも画期的な出来事です。

筆者の見解:民主化の次に来るもの

筆者は、今回のリリースがAI業界の「コモディティ化の加速」を示していると考えています。フラッグシップモデルの性能差は確実に縮まっており、miniやnanoのような「十分な性能を低コストで」提供するモデルが主戦場になりつつあります。

これは、AIモデルそのものの価値が下がるということではありません。むしろ、「モデルの性能」から「モデルの上に何を作るか」に競争の軸がシフトしていることを意味します。開発者やビジネスにとって重要なのは、「どのモデルが最高性能か」ではなく、「このコスト構造で何を実現できるか」です。

GPT-5.4 mini/nanoのリリースは、その問いに対する答えの幅を大きく広げました。個人的には、nanoの登場が最も大きなインパクトだと感じています。miniは「既存の有料モデルが無料になった」という延長線上の変化ですが、nanoは「これまでコスト的に不可能だったユースケースを可能にする」という質的な変化です。月間1,000万リクエストのアプリケーションでも、入力コストが$2,000で済む世界。これは1年前には想像できなかった数字です。

可能性は広がっています。あとは、それを活かすアイデアと実行力次第です。

10. よくある質問

Q1. GPT-5.4 miniとGPT-5.4の違いを一言で言うと?

性能はフラッグシップの約9割、価格は約3分の1です。コンテキストウィンドウがフラッグシップの約38%(40万トークン)である点が最大の違いですが、対応ツールや機能面はほぼ同等です。「コストを抑えつつ高い性能が欲しい」場合に最適なモデルです。

Q2. GPT-5.4 nanoはChatGPTで使えますか?

使えません。nanoはAPI専用モデルです。ChatGPT(Webブラウザやアプリ)での利用はできないため、利用にはOpenAI APIのアカウントとプログラミングの知識が必要です。ChatGPTで最新モデルを使いたい場合は、GPT-5.4 miniをThinking機能経由で利用してください。

Q3. 無料ユーザーがGPT-5.4 miniを使う方法は?

ChatGPTにログインし、メッセージ入力欄の左にある「+」ボタンから「Thinking」を選択するだけです。5時間あたりのメッセージ数に制限がありますが、追加料金は一切かかりません。

Q4. miniとnanoの両方をAPIで使い分けることはできますか?

はい、可能です。APIリクエスト時にモデル名(gpt-5.4-mini または gpt-5.4-nano)を指定するだけで切り替えられます。1つのアプリケーション内で「分類はnano、回答生成はmini」と使い分けるのは、コスト最適化の定石です。いわば、受付で用件を振り分ける係と専門的に対応する担当者を分けるコールセンターのようなものです。

Q5. GPT-5.1をAPIで使い続けても大丈夫ですか?

現時点ではAPIからの引退日は発表されていないため、すぐに停止する必要はありません。ただし、OpenAIは引退時に事前通知すると表明しています。性能面でもGPT-5.4 miniの方が上回っているため、新規開発ではminiまたはnanoの採用を推奨します。既存システムも、計画的な移行を進めておくのが安心です。

Q6. nanoの「推論努力」パラメータとは何ですか?

推論努力(reasoning effort)は、モデルが回答にどれだけ「考える時間」をかけるかを制御するパラメータです。「高」に設定すると処理時間は長くなりますが精度が向上し、「低」に設定すると高速・低コストで応答します。大量の分類タスクでは「低」で高速処理し、判断が難しいケースだけ「高」で再処理する、という使い分けが効果的です。

Q7. 開発経験がなくてもminiやnanoの恩恵を受けられますか?

もちろんです。GPT-5.4 miniはChatGPTの無料アカウントからThinking機能で利用できるため、プログラミングの知識は不要です。nanoはAPI専用のため開発知識が必要ですが、miniだけでも「フラッグシップの9割の性能」を無料で体験できます。まずはChatGPTのThinking機能から試してみてください。

11. まとめ──「最新AIは有料だけ」の時代は終わった

GPT-5.4 miniとnanoのリリースは、AI業界の大きな転換点です。

GPT-5.4 miniは、フラッグシップの9割の性能を3分の1の価格で提供し、さらに無料ユーザーにもThinking機能経由で開放されました。「最新の高性能AIを使うには有料プランが必須」という常識を覆した存在です。

GPT-5.4 nanoは、API入力$0.20/MTokenという破格の低コストで、分類・抽出・ランキングに特化した開発者向けモデルです。大量処理のコスト障壁を取り払い、これまで「コストに見合わない」と棚上げされていたAI活用のアイデアを一気に実現可能にしました。Batch APIを使えばさらに半額。AIを組み込んだプロダクトのビジネスモデルを根本から変える可能性を持っています。

そして、GPT-5.1の引退が示すように、AIモデルの世代交代サイクルは加速の一途をたどっています。今日のフラッグシップは、数ヶ月後には小型モデルや無料枠に置き換えられます。

この記事で紹介したminiとnanoの違い、料金、使い分けの指針を参考に、ぜひ自分のユースケースで試してみてください。ChatGPTの無料アカウントでminiのThinking機能を試すのに必要なのは、メールアドレスだけです。AI導入ガイドでも解説している通り、まずは小さく始めることが成功への近道です。APIを試したい開発者は、OpenAIのダッシュボードでアカウントを作成すれば数分で始められます。AIの進化は速いですが、「まず触ってみる」というシンプルな一歩が、最も確実な最適解への近道です。

参照元

- OpenAI公式ブログ – Introducing GPT-5.4 mini and nano

- OpenAI API Pricing

- OpenAI API Docs – GPT-5.4 mini

- OpenAI API Docs – GPT-5.4 nano

- OpenAI Help Center – GPT-5.4 in ChatGPT

- OpenAI Help Center – Retiring older ChatGPT models

- OpenAI API Deprecations

- The Decoder – GPT-5.4 mini and nano: faster and more capable

- Simon Willison’s Weblog – 76,000 photos processing with GPT-5.4 mini

- Anthropic – Claude API Pricing

- Google – Gemini Developer API Pricing