生成AIセキュリティ比較|ChatGPT・Claude・Gemini・Copilot法人プランの安全性を徹底検証【2026年版】

「法人プランなら安全」──その思い込みが、生成AIセキュリティの最大の落とし穴です。ChatGPT Enterprise、Claude Enterprise、Gemini for Workspace、Copilot for Microsoft 365。4大AIプラットフォームはすべて法人向けセキュリティ機能を備えていますが、その内容は驚くほど異なります。

前回の記事では、社員の無断AI利用「シャドーAI」が企業にもたらすリスクを解説しました。では、法人契約に切り替えれば万事解決なのか?答えはNoです。SOC 2認証の有無、データの保持期間、学習への利用ポリシー、SSO対応、DLP連携──14のセキュリティ項目で比較すると、各社の差は歴然です。

この記事では、生成AIセキュリティ比較の決定版として、4大AIの法人プランを徹底検証します。「うちの会社にはどのAIが最適か」を、セキュリティの視点から判断できるようになる内容です。

1. なぜ法人プランのセキュリティ比較が重要なのか

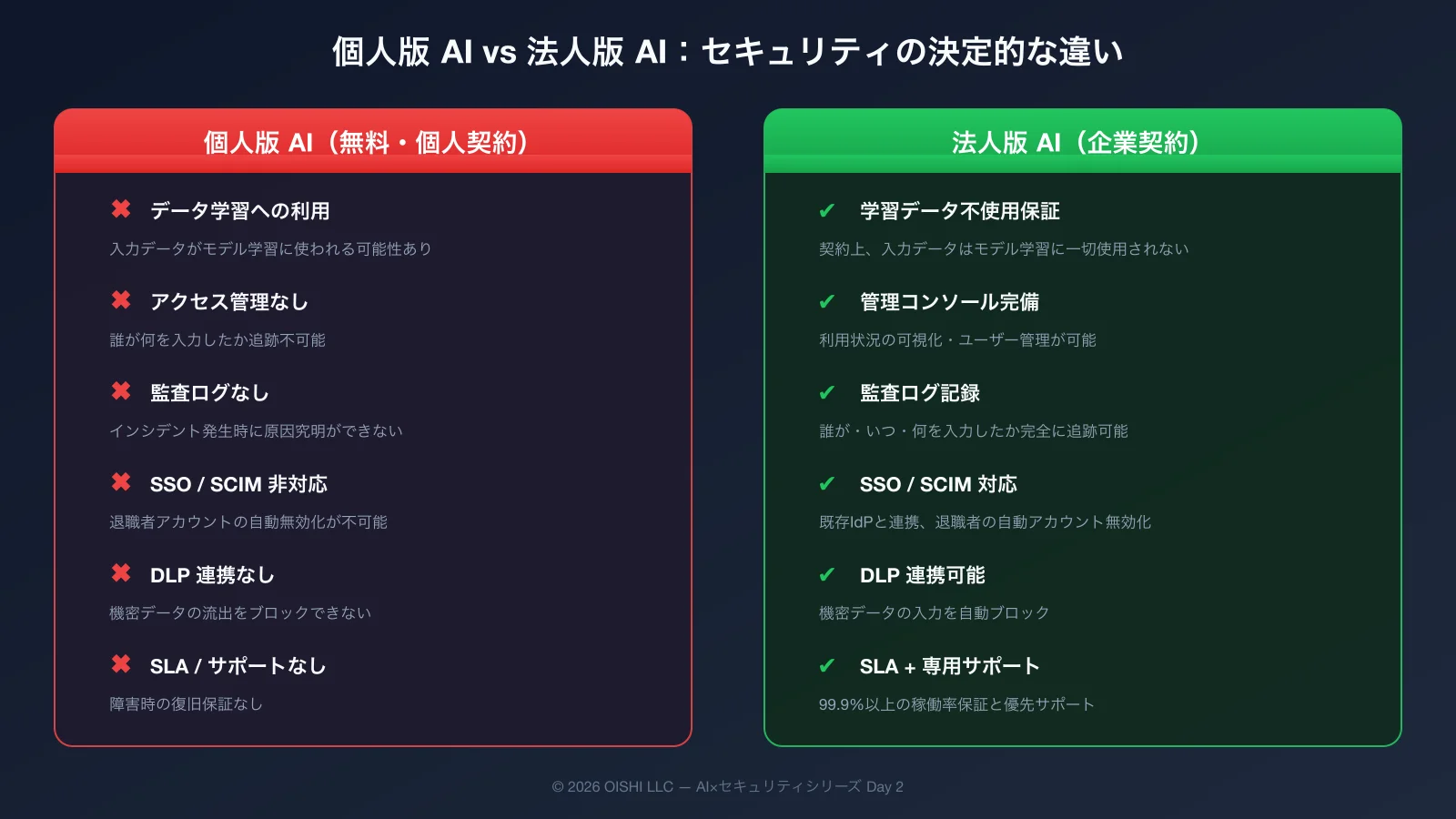

シャドーAI対策の第一歩は、社員に「公式の安全なAI環境」を提供することです。シャドーAI対策ガイドで解説した通り、個人アカウントでのAI利用は情報漏洩の温床になります。しかし、法人プランに移行すればすべて解決するわけではありません。

「法人版=安全」は思考停止

法人プランには、認証取得状況、データの取り扱いポリシー、管理機能の充実度に大きな差があります。たとえば、SSO(シングルサインオン)に対応しているプランと非対応のプランでは、退職者のアカウント管理の容易さが根本的に異なります。SSOに対応していなければ、退職者のAIアカウントが放置され、そこから情報が流出するリスクが残ります。これはいわば、退職した社員がオフィスの鍵を持ったまま去ってしまうようなものです。

もう1つの例がDLP(Data Loss Prevention)連携です。Microsoft Copilotは自社のPurviewとネイティブ統合されており、機密データのAIへの入力を自動的にブロックできます。一方、他のサービスではAPI経由での連携が必要で、導入の手間とコストが大きく変わります。

比較の全体像:14のセキュリティ項目

本記事では、以下の14項目で4つのAIプラットフォームを横断的に比較します。これらは、筆者が企業のAI導入支援の現場で「契約前に確認すべき」と考える必須チェック項目です。

- 認証・規格:SOC 2 Type II / ISO 27001 / HIPAA対応

- データ保護:学習データ不使用保証 / データ保持期間 / データリージョン / 暗号化

- アクセス管理:SSO・SAML / SCIM(自動プロビジョニング)/ RBAC(ロールベースアクセス制御)

- 運用管理:DLP連携 / 監査ログ / API制御 / SLA

2. 比較対象4サービスの概要と法人プラン体系

まず、比較対象となる4つのAIプラットフォームの法人プランを整理します。AI性能そのものの比較は別記事で詳しく解説していますので、ここではセキュリティに特化した観点でプラン体系を把握しましょう。

ChatGPT Business / Enterprise(OpenAI)

OpenAIは2025年8月に旧「ChatGPT Team」を「ChatGPT Business」にリブランドしました。Businessは月額25ドル/ユーザー(年払い)で、2名から利用可能です。GPT-5へのアクセス、共有ワークスペース、SSO(SAML)、基本的な管理機能が含まれます。Enterpriseはカスタム価格で、SCIM、監査ログ、データリージョン指定など高度なセキュリティ機能がフル装備されます。

Claude Team / Enterprise(Anthropic)

AnthropicのClaude Teamは月額25ドル/ユーザー(年払い)の標準シートに加え、Claude Codeが使えるプレミアムシート(月額150ドル)を提供しています。最低5名から利用可能です。注目すべきは、TeamプランでもSSO・ドメインキャプチャに対応している点です。Enterpriseはカスタム価格で、SCIM、監査ログ、カスタムデータ保持ポリシー、ゼロデータリテンション(ZDR)などが利用可能です。

Gemini for Google Workspace(Google)

Googleは2025年1月に戦略を大転換し、GeminiをGoogle Workspaceの全プランに標準搭載しました。Workspace Business Standardが月額14ドル/ユーザーからで、追加料金なしでGeminiが利用できます。Enterprise Plus(月額25.99ドル/ユーザー)では、さらに高度なAI機能やセキュリティ制御が利用可能です。すでにGoogle Workspaceを使っている企業にとっては、最もシームレスな導入パスになります。

Copilot for Microsoft 365(Microsoft)

Microsoft 365 Copilotは月額30ドル/ユーザーのアドオンとして提供されます。Microsoftは定期的に料金体系を見直しており、Copilotを含むバンドルプランも拡充されています。M365環境をすでに運用している企業にとっては、既存のセキュリティ基盤をそのまま活用できる点が最大の強みです。

3. セキュリティ機能14項目を徹底比較

ここからが本記事の核心です。4大AIプラットフォームのセキュリティ機能を14項目で横断比較します。この表は、導入検討時のチェックリストとしてそのまま使えるように設計しました。

| セキュリティ項目 | ChatGPT Business / Enterprise |

Claude Team / Enterprise |

Gemini for Workspace |

Copilot for M365 |

|---|---|---|---|---|

| 1. SOC 2 Type II | ✅ | ✅ | ✅(SOC 1/2/3) | ✅ |

| 2. ISO 27001 | ✅(27001 + 27701 + 42001) | ✅(27001 + 42001) | ✅(27001/17/18 + 42001) | ✅(27001 + 42001) |

| 3. HIPAA対応(BAA) | Enterprise / API ✅ | Enterprise / API ✅ | ✅ | ✅ |

| 4. 学習データ不使用保証 | Business ✅ / Enterprise ✅ | Team ✅ / Enterprise ✅ | ✅(Workspace契約) | ✅ |

| 5. データ保持期間 | 30日(Enterprise: ZDR可) | 30日(Enterprise: ZDR可) | Google Cloud準拠 | M365ポリシー準拠 |

| 6. SSO / SAML | Business ✅ / Enterprise ✅ | Team ✅ / Enterprise ✅ | ✅(Workspace連携) | ✅(Entra ID) |

| 7. SCIM | Enterprise ✅ | Enterprise ✅ | ✅ | ✅ |

| 8. DLP連携 | API経由 | API経由 | Google DLP統合 | Purview統合 |

| 9. 監査ログ | Enterprise ✅ | Enterprise ✅ | ✅(Workspace監査ログ) | ✅(統合監査ログ) |

| 10. データリージョン | Enterprise: 10リージョン | Enterprise ✅ | US/EU(CMEK対応) | M365データ境界 |

| 11. 保存時暗号化 | AES-256 | AES-256 | AES-256 + CMEK | AES-256 |

| 12. RBAC | Enterprise ✅ | Enterprise ✅ | ✅(Workspace連携) | ✅(Entra ID連携) |

| 13. API制御 | Enterprise ✅ | Team / Enterprise ✅ | ✅ | ✅ |

| 14. SLA | Enterprise: 99.9% | Enterprise: 個別交渉 | Workspace SLA準拠 | M365 SLA: 99.9% |

この比較表から、いくつかの重要なパターンが見えてきます。

まず、GeminiとCopilotは既存のクラウド基盤と深く統合されているため、DLP・SSO・監査ログがネイティブで機能します。たとえるなら、GeminiやCopilotは「社内に常駐する警備員」のようなもので、建物のセキュリティシステムと最初から連動しています。一方、ChatGPTとClaudeはスタンドアロンのAIサービスとして提供されており、いわば「外部から呼ぶ派遣スタッフ」に近く、既存の企業インフラとの統合には追加の設定が必要です。

次に、SSOは4社いずれの法人プランでも対応済みです。ただし、SCIM(自動プロビジョニング)についてはChatGPT・ClaudeともにEnterprise限定です。退職者のアカウント自動無効化にはSCIMが必要なため、中堅企業以上ではSCIM対応の有無がプラン選定の分かれ目になります。

そして筆者が最も注目する点は、コンプライアンス認証の数と実際の安全性は必ずしもイコールではないということです。認証はあくまで「最低限の基準を満たしている」ことの証明であり、言い換えれば運転免許を持っていることと安全運転をしていることは別問題です。日常的なデータ管理の運用品質は認証だけでは判断できません。この点については次のセクションで掘り下げます。

4. データプライバシー:あなたの入力データはどこへ行くのか

法人AIを選ぶうえで最も重要なのは、「自社のデータがどう処理され、どこに保存され、いつ削除されるか」を正確に理解することです。「学習に使われません」という一言だけでは不十分です。

各社のデータ処理フロー

OpenAI(ChatGPT Business/Enterprise)は、法人プランの入力データをモデルの学習に使用しないことを契約で保証しています。ただし、不正利用防止のためにデータを最大30日間保持します。Enterprise契約ではゼロデータリテンション(ZDR)を設定でき、APIレスポンス返却後にデータを即時削除する運用が可能です。ただし、フィードバック(サムアップ/ダウン)を送信すると、その会話が学習対象に明示的にオプトインされる点には注意が必要です。

Anthropic(Claude Team/Enterprise)も同様に、法人プランのデータを学習に使用しません。標準のデータ保持期間は30日で、Enterprise API顧客にはZDRオプションが用意されています。ZDR有効時は、プロンプトと出力がリアルタイムで処理され、即座に破棄されます。ただし、利用ポリシー違反の検知に必要なUser Safety分類結果は保持される仕様です。

Google(Gemini for Workspace)は、Workspace契約のもとで入力データをモデル学習に使用しません。データ処理はGoogle Cloudのデータ処理規約に従い、顧客が選択したリージョン(US/EU)内で行われます。CMEK(Customer Managed Encryption Keys)により、暗号化鍵を顧客自身が管理できる点は、金融・医療などの規制業界にとって大きなメリットです。

Microsoft(Copilot for M365)は、プロンプト・レスポンス・Microsoft Graph経由でアクセスしたデータのいずれも基盤モデルの学習には使用しません。データの処理と保存はMicrosoft 365の既存のセキュリティポリシーに従います。ただし、2026年1月からAnthropicがCopilotのサブプロセッサーに追加されており、AnthropicのモデルはEUデータ境界の対象外です。EU規制が厳しい企業はこの点を契約前に確認すべきです。

筆者の見解:データリージョンは過大評価されている

「データが日本国内に保存されるか」を気にする企業は多いですが、筆者はこの点が過大評価されていると考えています。なぜなら、現時点で日本リージョンを提供しているAIプラットフォームは限定的であり、より重要なのは通信経路の暗号化(TLS 1.2/1.3)と保存時の暗号化(AES-256)が確実に適用されているかだからです。データの物理的な保存場所よりも、アクセス制御と暗号化の堅牢性がセキュリティの実効性を左右します。もちろん、法規制で明示的にデータ国内保存が求められるケースは例外です。

5. コンプライアンス対応力の比較

企業のAI導入において、コンプライアンス対応は「あったら嬉しい」ではなく「なければ導入できない」要件です。特に金融、医療、官公庁といった規制業界では、認証の有無が導入の前提条件になります。

SOC 2 Type II:全社クリア

SOC 2 Type IIは、セキュリティ・可用性・機密性・プライバシーに関する内部統制を独立監査人が検証する認証です。4社すべてがSOC 2 Type IIを取得しています。OpenAIの最新の監査レポートは2025年1月〜6月の期間をカバーしており、Trust Portal経由で閲覧可能です。Anthropicも同様にSOC 2 Type IIを取得しており、Trust Centerで確認できます。

ISO 27001:基本に差異なし、注目は42001

ISO 27001(情報セキュリティマネジメント)も4社すべてが取得済みです。さらに注目すべきはISO/IEC 42001(AI管理システム)で、AI特有のリスク管理に関する国際規格です。OpenAI、Anthropic、Google、Microsoftの4社すべてが取得済みであり、AI管理の標準化が業界全体で進んでいることがわかります。加えてOpenAIはISO 27701(プライバシー情報管理)も取得しています。

HIPAA:医療業界の導入判断を左右

HIPAA対応はBAA(Business Associate Agreement)の締結が前提です。GoogleとMicrosoftはWorkspace/M365全体でBAA締結が可能であり、医療機関にとって導入しやすい構造です。OpenAIはEnterprise/API契約、AnthropicはEnterprise/API契約でBAA締結が可能です。

日本の法規制への適合度

個人情報保護法については、4社ともDPA(データ処理契約)を提供しており、個人データの越境移転に対する安全管理措置を定めています。AI事業者ガイドライン v1.1(2025年3月、経産省・総務省)は法的拘束力はありませんが、取引先からの要求事項として実質的な準拠が求められるケースが増えています。このガイドラインは「AI利用者」にも適切な利用ポリシーの策定を求めており、法人AIの導入自体がガイドライン対応の第一歩になります。

2026年度末頃に運用開始予定のサプライチェーンセキュリティ対策評価制度(経産省)では、企業のセキュリティ対策を★3〜★5の3段階で可視化する仕組みが導入されます。AI利用のガバナンスも評価対象に含まれるため、法人AIの適切な導入・運用は評価制度対応にも直結します。

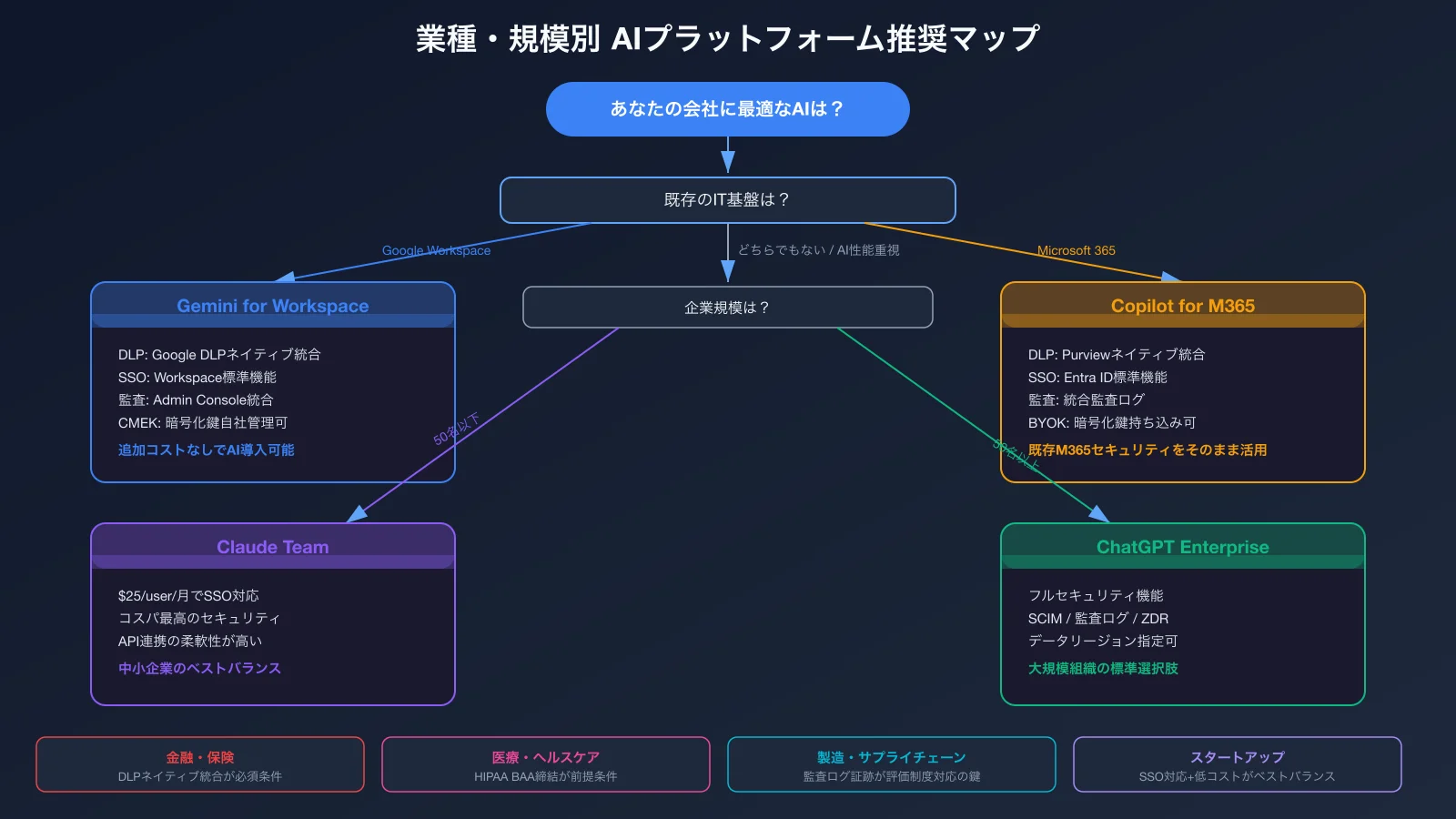

6. 業種・規模別おすすめプラットフォーム

ここまでの比較を踏まえ、業種と企業規模に応じた最適なプラットフォームを提案します。ただし、これはセキュリティの観点からの推奨であり、AI性能の比較はChatGPT vs Claude vs Gemini 徹底比較を参照してください。

金融業・保険業:Copilot for M365 または Gemini Enterprise

金融業はFISC安全対策基準への準拠が必要で、DLPのネイティブ統合と監査ログの充実度が決定打になります。Microsoft環境の企業ならCopilot+Purview、Google Workspace環境ならGemini+Google DLPの組み合わせが、追加コストなしでDLP連携を実現できます。

医療・ヘルスケア:BAA締結可能なプラットフォーム

HIPAA対応が前提条件です。GoogleとMicrosoftはプラットフォーム全体でBAA締結が可能なため導入がスムーズです。Anthropicは2026年1月に「Claude for Healthcare」を発表し、医療分野での活用基盤を整えています。

製造業・サプライチェーン関連:既存インフラとの親和性重視

サプライチェーンセキュリティ対策評価制度の対象となる企業は、監査ログとアクセス管理の証跡が評価のポイントです。既存のIT基盤がMicrosoft環境ならCopilot、Google環境ならGeminiを選ぶことで、セキュリティ証跡の統合管理が容易になります。

スタートアップ・中小企業(50名以下):Claude Team

コストとセキュリティのバランスが重要です。ChatGPT BusinessもClaude Teamも月額25ドル/ユーザーでSSO対応しており、少人数でも基本的なアクセス管理が可能です。ただしSCIM(自動プロビジョニング)が必要な場合はEnterprise契約が必要です。AIエージェントの活用を視野に入れるなら、API連携の柔軟性が高いClaude/ChatGPTが選択肢に入ります。

筆者の見解:最も安全なAIは「使われないAI」

セキュリティ機能が充実していても、社員がそのAIを使いたがらなければ意味がありません。UIが複雑、レスポンスが遅い、回答品質が低い──これらの理由で社員が公式AIを敬遠し、個人アカウントの無料版に戻ってしまえば、シャドーAIの問題は再燃します。セキュリティとUXのバランスが、プラットフォーム選定の最終的な判断基準です。

7. 導入前に確認すべきセキュリティチェックポイント

プラットフォームを選定したら、契約前に以下の10項目を確認してください。これはPoC(概念実証)段階でのセキュリティ評価チェックリストとしても活用できます。

契約前の10項目チェック

- DPA(データ処理契約)の内容確認:データの処理目的、保存場所、保持期間、削除方法が明記されているか

- 学習利用ポリシーの確認:入力データがモデルの学習に一切使用されないことが契約上保証されているか

- データ保持期間と削除手順:不正利用監視のためのデータ保持期間はどの程度か。ZDRオプションは利用可能か

- SSO/SCIM対応の確認:自社のIdP(Identity Provider)との連携は検証済みか。退職者のアカウント自動無効化は可能か

- DLP連携の実現方法:既存のDLPツールとネイティブ統合か、API経由か。導入の工数はどの程度か

- 監査ログの粒度と保持期間:誰が・いつ・何を入力し・何が出力されたかを追跡できるか。ログの保持期間は十分か

- インシデント対応体制:セキュリティインシデント発生時の通知フロー、対応SLAは明確か

- サブプロセッサーの確認:データ処理に関与する第三者企業(サブプロセッサー)のリストと管理体制は公開されているか

- コンプライアンス認証の最新状況:SOC 2レポートの監査対象期間は直近か。監査レポートは閲覧可能か

- 契約終了時のデータ処理:解約後のデータ削除プロセスと完了証明書の発行は保証されているか

PoC時のセキュリティ評価方法

PoC(概念実証)の段階から、以下の3つのテストを実施することをおすすめします。まず、テストデータによるDLP検証です。機密情報を模したダミーデータをAIに入力し、DLPが正しくブロックするかを確認します。次に、退職者シミュレーションです。テストユーザーのアカウントを無効化した後、そのアカウントの会話履歴が適切にアクセス不能になるかを検証します。最後に、監査ログの検証です。入力したプロンプト・出力・タイムスタンプ・ユーザー情報が監査ログに正しく記録されるかを確認します。

ひとりAIチームの作り方でも解説しましたが、AIの導入は小さく始めて段階的に拡大するのが鉄則です。セキュリティ検証も同様に、まず少人数のPoCで運用実態を把握し、課題を洗い出してから全社展開に進みましょう。

よくある質問

Q1. 法人プランなら入力データは絶対に安全ですか?

法人プランではモデルの学習にデータが使用されないことが契約で保証されます。ただし、不正利用監視のために一定期間データが保持される点、フィードバック送信による意図しないオプトインの可能性がある点は理解しておく必要があります。「法人版=完全安全」ではなく、正しい設定と運用が前提です。

Q2. 4つのAIを同時に使い分けても問題ありませんか?

問題ありません。むしろ用途に応じた使い分けは合理的な戦略です。重要なのは、すべてのAIが法人契約であることと、統合的な監査ログの仕組みを整えることです。ただし、管理するサービスが増えるほど運用コストも上がるため、コストとセキュリティのバランスを考慮してください。

Q3. 無料版のAIを業務で使うのは法的に問題ですか?

直ちに「違法」ではありませんが、重大なリスクがあります。無料版では入力データがモデルの学習に使われる可能性があり、個人情報や機密情報を入力した場合は個人情報保護法やNDA(秘密保持契約)に抵触するおそれがあります。企業としては、法人プランの導入と利用ガイドラインの策定で対応すべきです。

Q4. SCIM非対応のプランでもセキュリティは確保できますか?

基本的なセキュリティは確保できますが、退職者のアカウント管理が手動になる点に注意が必要です。SSOは主要な法人プランで対応済みですが、SCIM(自動プロビジョニング)はEnterprise限定のサービスが多く、SCIM非対応の場合はアカウントの削除漏れが発生するリスクがあります。アカウント棚卸の定期実施と退職時チェックリストの整備で補完してください。

Q5. この記事の情報は2026年3月時点のものですか?

はい、2026年3月時点の公式情報に基づいています。AI業界の変化は非常に速く、料金体系や認証状況は頻繁に更新されます。導入検討時には必ず各社の公式サイトで最新情報を確認してください。特に料金については、為替レートの変動により円建て換算が変わる点にも注意が必要です。

まとめ:セキュリティで選ぶ法人AI、最適解の見つけ方

生成AIの法人プラン選定において、セキュリティは「後から考える」ものではなく、最初に確認すべき前提条件です。本記事の14項目比較から見えた3つの重要ポイントを振り返ります。

第一に、GeminiとCopilotは既存インフラとの統合力が圧倒的です。すでにGoogle WorkspaceまたはMicrosoft 365を使っている企業にとって、DLP・SSO・監査ログがネイティブに機能する価値は、追加のセキュリティ製品を導入するコストと手間を考えれば計り知れません。

第二に、ChatGPTとClaudeはAI性能に強みがあり、API連携の柔軟性が高いです。ChatGPT BusinessもClaude TeamもSSO対応済みで、特にClaudeはHIPAA対応やZDRオプションなど、コストに対するセキュリティ機能の充実度が際立ちます。

第三に、そして最も重要なのは、認証や機能の数だけで安全性を判断してはいけないということです。認証はスタートラインであり、ゴールではありません。ちょうど健康診断で「異常なし」と出ても、日々の生活習慣が健康を左右するように、導入後の運用──アクセス管理、監査ログのモニタリング、ガイドラインの定期更新──が、実際の安全性を決めます。

本記事はAI×セキュリティシリーズの第2弾です。次回の最終回では、「明日から使えるAIセキュリティチェックリスト50項目」として、導入前・運用中・四半期レビューで使える実践的なチェックリストを提供します。

参照元

- OpenAI「Enterprise privacy at OpenAI」

- OpenAI「Business data privacy, security, and compliance」

- OpenAI Trust Portal(SOC 2レポート公開)

- OpenAI「Expanding data residency access to business customers worldwide」(2026年)

- Anthropic「What Certifications has Anthropic obtained?」

- Anthropic「Zero Data Retention (ZDR)」

- Anthropic Trust Center

- Google Cloud「Compliance certifications and security controls – Gemini Enterprise」

- Google「Generative AI in Google Workspace Privacy Hub」

- Microsoft「Data, Privacy, and Security for Microsoft 365 Copilot」

- Microsoft「Security for Microsoft 365 Copilot」

- 経済産業省・総務省「AI事業者ガイドライン(第1.1版)」(2025年3月)

- 経済産業省「サプライチェーン強化に向けたセキュリティ対策評価制度 中間取りまとめ」(2025年4月)

- IPA「情報セキュリティ10大脅威 2026」