AIセキュリティ対策チェックリスト|「うちのAI大丈夫?」に答える担当者ガイド【2026年版】

「うちのAI、大丈夫?」──上司や経営層からこの質問を受けたとき、AIセキュリティの担当者として自信を持って答えられますか?IPAが発表した「情報セキュリティ10大脅威 2026」では、「AIの利用をめぐるサイバーリスク」が初選出で第3位にランクイン。AIセキュリティ対策は、いわば「家に鍵をかける」のと同じくらい当たり前のことになりつつあり、もはや「いずれやる」ではなく「今すぐやる」フェーズに入っています。

本シリーズでは、第1回でシャドーAIのリスクを明らかにし、第2回で4大AIプラットフォームのセキュリティ比較を行いました。最終回の本記事では、「結局うちは何をすればいい?」という疑問に、明日から使える実践チェックリスト50項目で答えます。

チェックリストは「導入前15項目」「運用中20項目」「四半期レビュー15項目」の3フェーズで構成しています。さらに、社内AIガイドラインのテンプレートと組織体制の設計図も提供します。印刷して手元に置いておけるよう、具体的かつ実務的な内容に徹しました。

1. AIセキュリティ対策が急務である理由【2026年の転換点】

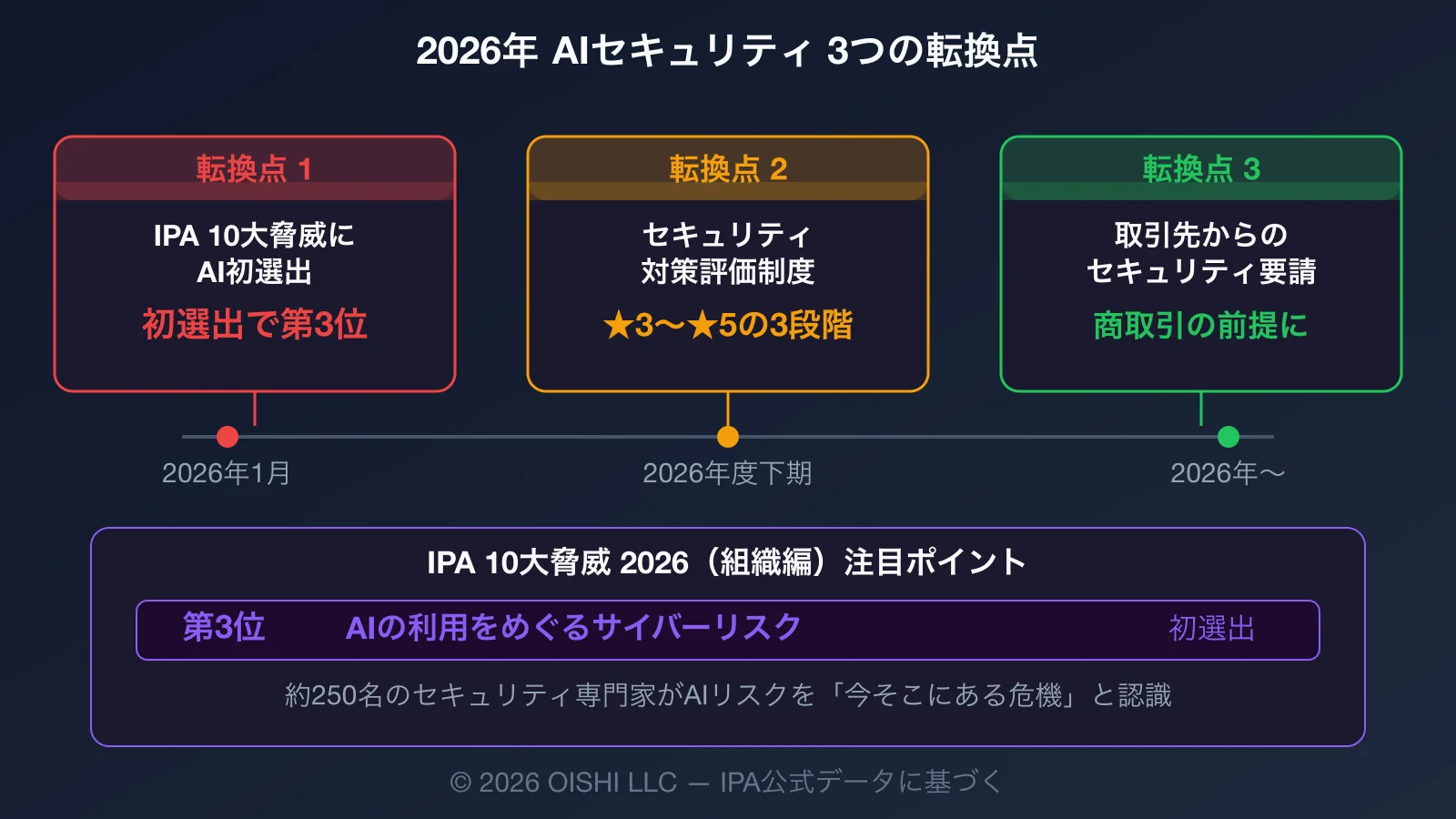

2026年は、企業のAIセキュリティにとって3つの転換点が重なる年です。この3つを理解すれば、なぜ今チェックリストが必要なのかが明確になります。

転換点1:IPA「情報セキュリティ10大脅威 2026」にAIリスクが初選出

2026年1月29日、IPAは11年の歴史で初めて「AIの利用をめぐるサイバーリスク」を10大脅威にランクインさせました。しかも初登場で第3位です。ランサムウェア(1位)とサプライチェーン攻撃(2位)に次ぐ位置づけは、日本のセキュリティ専門家約250名がAIリスクを「今そこにある危機」と認識していることを意味します。

IPAが指摘するAIリスクは多岐にわたります。AIに対する不十分な理解に起因する意図しない情報漏洩、AIの出力を検証せず鵜呑みにすることで生じる業務判断ミス、そしてAIの悪用によるサイバー攻撃の高度化──これらすべてが組織の脅威として認識されたのです。

転換点2:サプライチェーンセキュリティ対策評価制度(2026年度下期開始)

経済産業省が2026年度下期の運用開始を目指す「サプライチェーン強化に向けたセキュリティ対策評価制度」は、企業のセキュリティ対策を★3〜★5の3段階で可視化する仕組みです。2025年4月に「中間取りまとめ」が公表され、NIST Cybersecurity Framework 2.0を基にした評価基準が具体化されています。

筆者はこの制度を「脅威」ではなく「攻めの武器」として捉えるべきだと考えています。早期に高い評価を取得した企業は、取引先選定で優位に立てます。特に大企業のサプライチェーンに入る中小企業にとって、セキュリティ評価は今後の受注を左右する差別化要因になるでしょう。AIの利用ガバナンスも評価対象に含まれるため、本記事のチェックリストは評価制度対応の第一歩にもなります。

転換点3:取引先からのセキュリティ要請の急増

大企業がサプライチェーン全体のセキュリティを重視する流れの中で、取引先に対して「AIの利用状況とセキュリティ対策」を問う質問票が増えています。「御社ではAIの利用ガイドラインを策定していますか?」「入力データの管理体制はどうなっていますか?」──これらの質問に、エビデンスをもって回答できるかどうかが、商取引の前提条件になりつつあります。

実際に、ある製造業の中堅企業では、大手取引先からの調達要件に「AI利用に関するセキュリティポリシーの提示」が追加されたことをきっかけに、本記事のようなチェックリストを整備しました。ポリシーを文書化して提示できたことで、取引継続だけでなく新規案件の受注にもつながったといいます。「セキュリティ対策ができている」ことが、信頼の証明になる時代です。

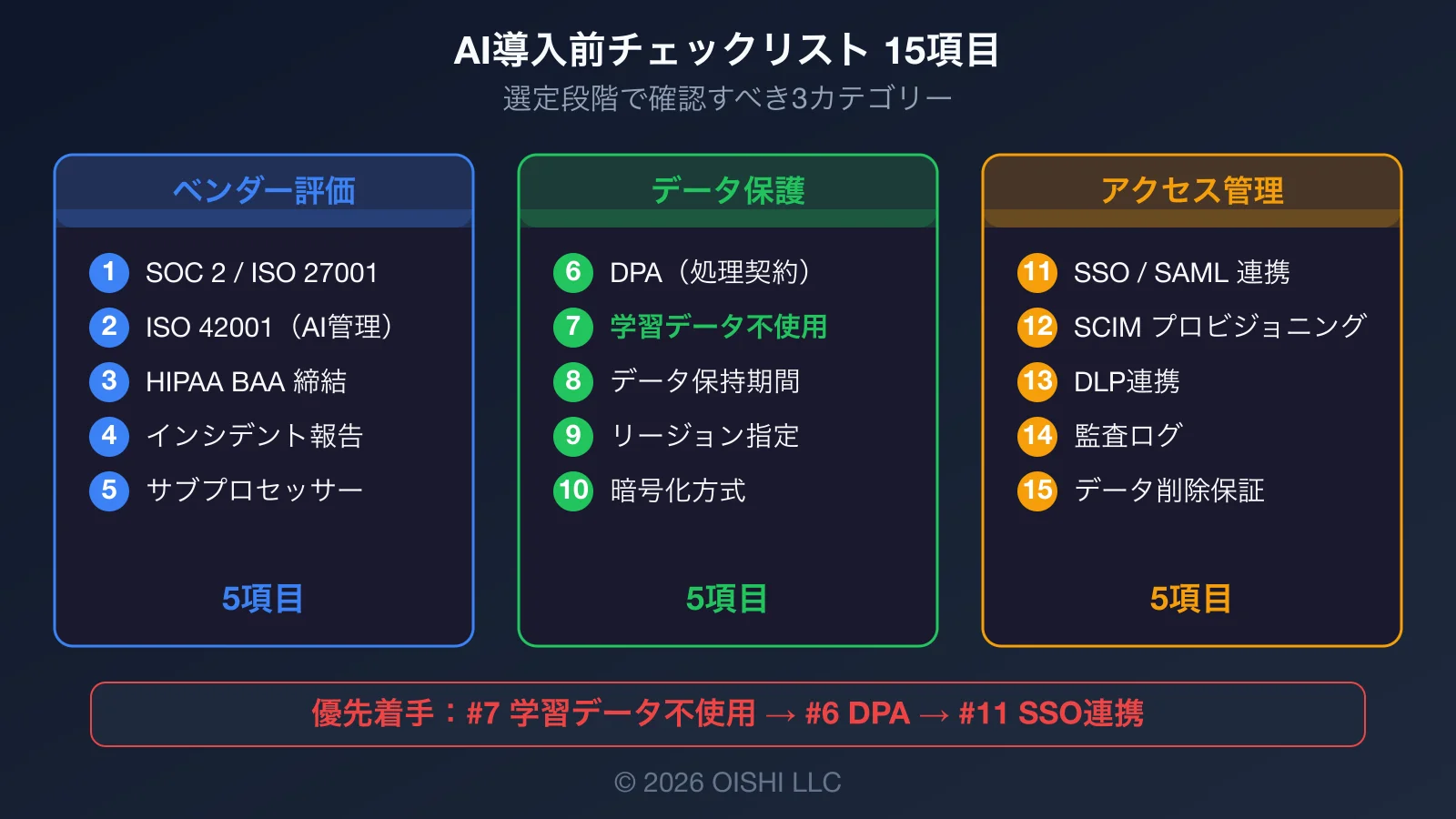

2. AI導入前チェックリスト:選定段階で確認すべき15項目

AIプラットフォームを選定する段階で確認すべき15項目です。前回の記事で比較した14のセキュリティ項目を、実務のチェックリストとして再構成しました。

ベンダー評価(5項目)

- SOC 2 Type II / ISO 27001の取得状況を確認したか:監査レポートの対象期間が直近(12か月以内)であることを確認する。古いレポートは信頼性が低い

- ISO/IEC 42001(AI管理システム)の取得状況を確認したか:AI特有のリスク管理に関する国際規格。2026年時点でOpenAI、Anthropic、Google、Microsoftの主要4社が取得済み

- HIPAA対応が必要な場合、BAA締結が可能か確認したか:医療データを扱う場合は必須。プラン別の対応状況を確認する(全プラン対応 vs Enterprise限定)

- 過去のセキュリティインシデント報告を確認したか:ベンダーのセキュリティブログやCVE報告を確認。インシデントの発生自体より、対応の透明性と速度を評価する

- サブプロセッサーのリストを確認したか:データ処理に関与する第三者企業を把握する。Microsoft CopilotがAnthropicをサブプロセッサーに追加した例のように、変更が発生することがある

データ保護(5項目)

- DPA(データ処理契約)を締結したか:処理目的・保存場所・保持期間・削除方法が明記されていることを確認

- 学習データ不使用が契約で保証されているか:「利用規約」ではなく「契約書」レベルでの保証を確認する。利用規約は一方的に変更される可能性がある

- データ保持期間を確認し、自社ポリシーと整合しているか:標準30日保持が一般的。ZDR(ゼロデータリテンション)が必要な場合はEnterprise契約を検討

- データリージョンの指定が可能か確認したか:法規制で国内保存が求められる場合は必須。ただし通信経路の暗号化(TLS 1.2以上)の方が実効性は高い

- 暗号化方式を確認したか:保存時AES-256は最低条件。CMEK(顧客管理暗号化鍵)やBYOK(鍵持ち込み)が利用可能か

アクセス管理・運用(5項目)

- SSO / SAML連携が自社のIdPで検証済みか:プランによってSSO対応状況が異なる。SCIMによる自動プロビジョニングはEnterprise限定のサービスが多いため注意

- SCIM(自動プロビジョニング)に対応しているか:退職者のアカウント自動無効化に必要。手動管理では削除漏れリスクが残る

- DLP連携の実現方法と工数を見積もったか:ネイティブ統合(Gemini+Google DLP、Copilot+Purview)か、API経由かで導入コストが大きく異なる

- 監査ログの粒度と保持期間を確認したか:「誰が・いつ・何を入力し・何が出力されたか」を追跡可能であることを確認

- 契約終了時のデータ削除プロセスを確認したか:解約後のデータ完全削除と証明書発行が保証されているか

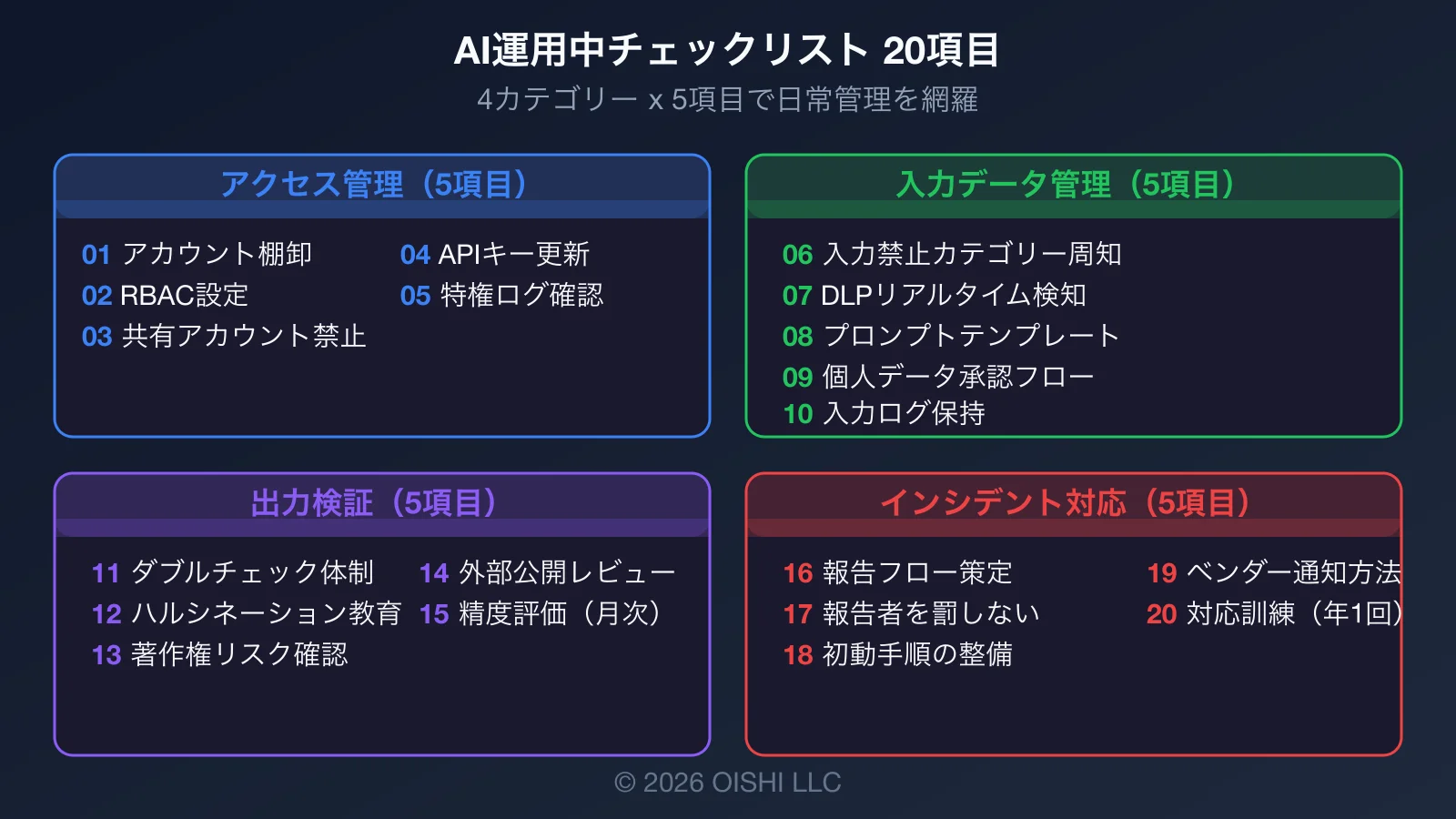

3. AI運用中チェックリスト:日常管理の20項目

AIを導入した後の日常管理で確認すべき20項目です。「導入したら終わり」ではなく、運用フェーズこそがセキュリティの本番です。チェックリストの導入前フェーズが「健康診断」だとすると、運用フェーズは「毎日の健康管理」のようなものです。

アクセス管理(5項目)

- アカウントの棚卸を月次で実施しているか:不要アカウント(退職者・異動者)が残っていないか確認。SSO連携でも手動確認は必要

- ロールベースのアクセス制御(RBAC)を設定しているか:部門・役職に応じた権限設定。全員が管理者権限を持つ状態は危険

- 共有アカウントの使用を禁止しているか:1人1アカウントの原則。共有アカウントでは「誰がその入力をしたか」が追跡不能

- API キーの管理とローテーションを実施しているか:APIキーは定期的にローテーション。退職者が作成したキーは即座に無効化

- 特権アカウント(管理者)の操作ログを定期確認しているか:管理者のアクションも監査対象。「管理者だから安全」という前提は持たない

入力データ管理(5項目)

- 入力禁止データのカテゴリーを明文化し周知しているか:個人情報、ソースコード、財務情報、未公開の経営情報、取引先の機密情報など

- DLPツールで機密データの入力をリアルタイム検知しているか:ルールベース+機械学習の二段構えが理想。DLPに例えると「空港の手荷物検査」に相当する仕組みで、危険物(機密データ)が外に出るのを水際で止めます。まずはルールベースから始める

- プロンプトテンプレートを部門別に整備しているか:安全な入力パターンを標準化。「自由入力」を減らすことでリスクを低減

- 外部の個人データをAIに入力する際の承認フローがあるか:顧客データ・取引先データの入力は上長承認を必須とする

- AIに入力したデータの記録(入力ログ)を保持しているか:監査ログとは別に、自社側でも入力内容のサンプル記録を推奨

出力検証(5項目)

- AIの出力を業務判断に使う際のダブルチェック体制があるか:「AIが言ったから正しい」は禁止。出力の事実確認を業務プロセスに組み込む

- ハルシネーション(AI の事実誤認)の社内教育を実施しているか:全社員が「AIは嘘をつく可能性がある」ことを理解している状態を目指す

- AIの出力に著作権侵害のリスクがないか確認するプロセスがあるか:特にコンテンツ生成では、出力の類似性チェックが必要

- AIの出力を外部公開する際のレビュープロセスがあるか:プレスリリース、顧客向け提案書などにAI出力を使う場合は、人間によるレビューを必須とする

- AIの出力精度を定期的に評価しているか:月次で出力サンプルを抽出し、精度・品質を評価。モデル更新による品質変動を把握する

インシデント対応(5項目)

- AI関連のインシデント報告フローを策定しているか:「AIに機密情報を入力してしまった」場合の即時報告→対応→記録のフローを整備

- 報告者を罰しない文化を明文化しているか:罰則を恐れて報告が遅れることが最大のリスク。「報告は評価する」と明記する

- インシデント発生時の初動対応手順を定めているか:アカウント停止→ログ保全→影響範囲の特定→関係者通知の手順

- ベンダーへのインシデント通知方法を把握しているか:データ削除要求のフロー、ベンダー側の対応SLAを事前に確認しておく

- インシデント対応の訓練を年1回以上実施しているか:机上演習でもよいので、実際のシナリオに基づいた訓練を定期実施する

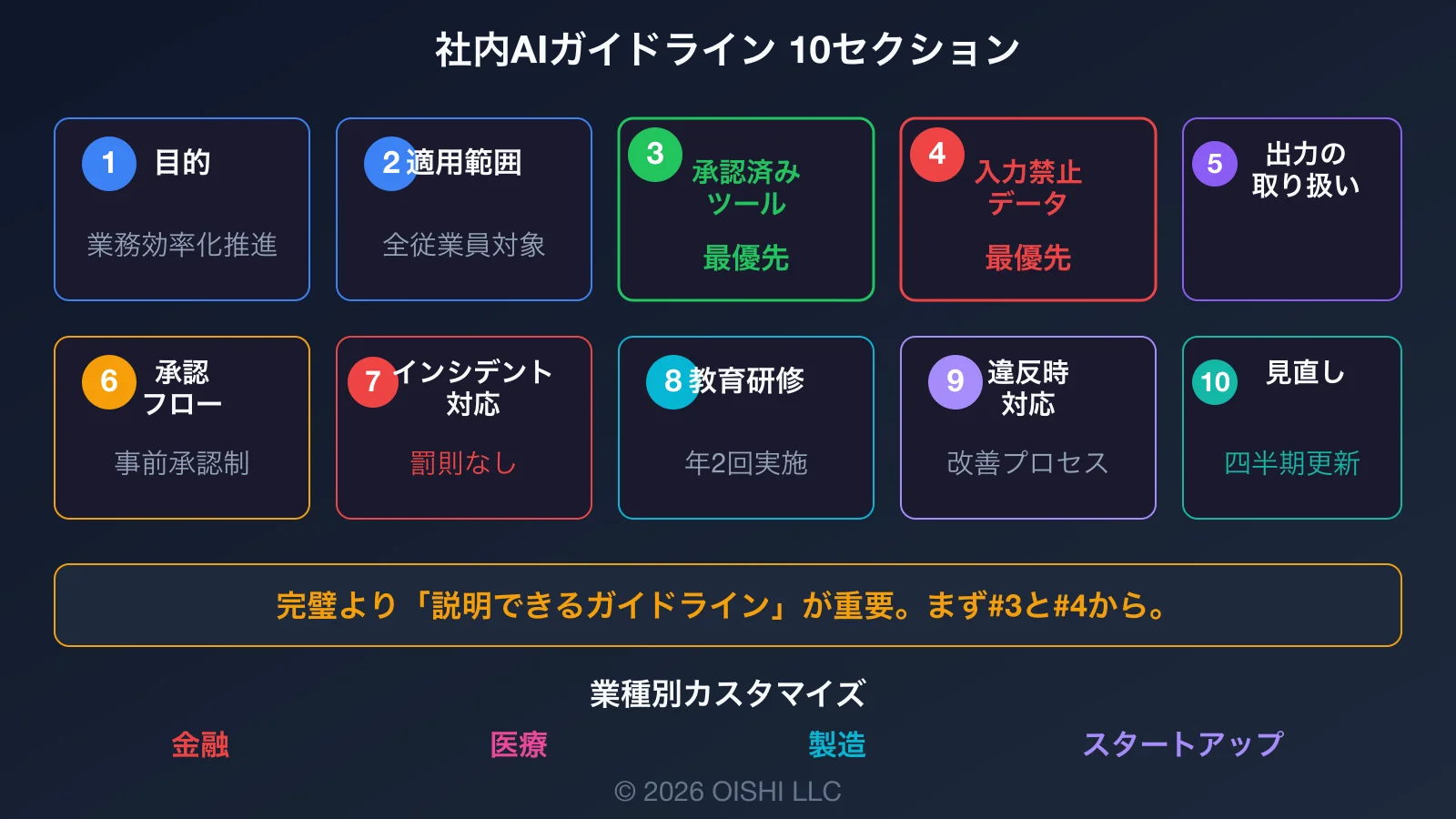

4. 社内AIガイドライン策定テンプレート

以下は、そのまま自社用にカスタマイズして使える社内AIガイドラインのテンプレートです。経済産業省「AI事業者ガイドライン v1.1」の要求事項をカバーしつつ、中小企業でも実践できるレベルに落とし込みました。

ガイドラインの骨格(10セクション構成)

- 目的:AIの安全な利用による業務効率化の推進と、セキュリティリスクの最小化

- 適用範囲:全従業員、業務委託先、派遣社員。業務に関連するすべてのAI利用が対象

- 承認済みAIツール:利用可能なAIツールのホワイトリスト。未承認ツールの業務利用は禁止

- 入力禁止データ:個人情報、ソースコード、財務情報、未公開経営情報、取引先機密情報、認証情報(パスワード・APIキー)

- 出力の取り扱い:AI出力は「下書き」として扱い、必ず人間が検証する。外部公開前のレビュー必須

- 承認フロー:新しいAIツールの利用開始時は情報セキュリティ担当者の事前承認が必要

- インシデント対応:機密情報の誤入力が発生した場合は、即座に情報セキュリティ担当者に報告。報告者への罰則なし

- 教育・研修:全従業員向けAIリテラシー研修を年2回実施。新入社員・中途入社者には入社時にオリエンテーション

- 違反時の対応:初回は注意指導と再教育。繰り返しの場合はアカウント一時停止と上長面談。懲戒ではなく改善プロセスとして設計

- 見直しスケジュール:四半期ごとにガイドラインを見直す。AI技術の進化に合わせて柔軟に更新

カスタマイズのポイント

このテンプレートはあくまで骨格です。自社の業種・規模・リスク許容度に応じて、以下の点をカスタマイズしてください。

- 金融業:FISC安全対策基準への言及を追加。AI出力の利用範囲を「社内検討用」に限定する条項を追加

- 医療業:HIPAA対応の条項を追加。患者データのAI入力は原則禁止とし、匿名化データのみ許可

- 製造業:図面・設計データのAI入力に関する個別規定を追加。取引先のNDAに抵触しないかの確認フロー

- スタートアップ:簡潔さを優先。まずセクション3(ホワイトリスト)とセクション4(入力禁止データ)の2つだけでも策定する

筆者の見解として、完璧なガイドラインより「説明できるガイドライン」が重要です。取引先から「御社のAI利用ポリシーは?」と聞かれたとき、文書を提示して「こういう方針で管理しています」と説明できること。この「説明責任を果たせる状態」を作ることが、ガイドライン策定の第一目的です。100点のガイドラインを半年かけて作るより、60点のガイドラインを今週中に策定して運用を始める方がはるかに価値があります。

5. 組織体制チェックリスト:誰が何を担当するか

AIセキュリティは「誰かがやってくれる」ものではありません。明確な役割分担と報告ラインがなければ、ガイドラインもチェックリストも形骸化します。

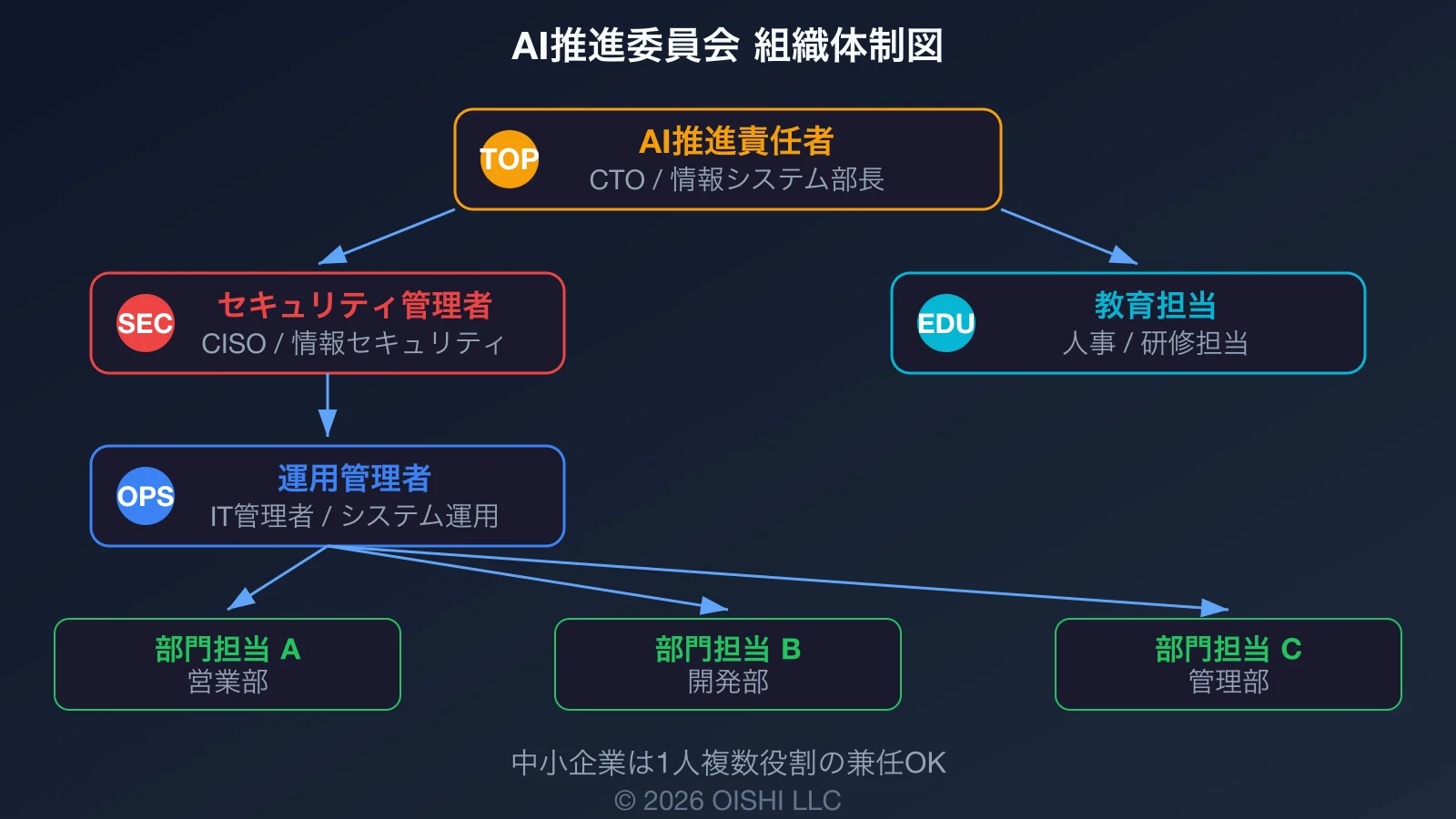

AI推進委員会の設置(推奨構成)

企業規模に関わらず、以下の役割を最低限カバーする体制を構築してください。中小企業では1人が複数の役割を兼任しても構いません。重要なのは、「誰が責任者か」が明確になっていることです。

| 役割 | 担当者の例 | 主な責務 | 報告先 |

|---|---|---|---|

| AI推進責任者 | CTO / 情報システム部長 | AI利用戦略の決定、予算承認、経営への報告 | 経営層 |

| セキュリティ管理者 | CISO / 情報セキュリティ担当 | セキュリティポリシー策定、リスク評価、インシデント対応統括 | AI推進責任者 |

| 運用管理者 | IT管理者 / システム運用担当 | アカウント管理、監査ログ確認、DLP設定・運用 | セキュリティ管理者 |

| 部門AI推進担当 | 各部門のリーダー / マネージャー | 部門内のAI利用状況の把握、ガイドライン遵守の確認 | 運用管理者 |

| 教育担当 | 人事 / 研修担当 | AIリテラシー研修の企画・実施、教材更新 | AI推進責任者 |

教育計画

AIリテラシー教育は「1回やったら終わり」ではありません。以下のスケジュールで継続的に実施してください。

- 入社時:AIガイドラインのオリエンテーション(30分程度)。承認済みツールと入力禁止データの説明

- 半期ごと:全社AIリテラシー研修(1時間)。最新のリスク事例、ハルシネーションのデモ、プロンプト活用テクニック

- 随時:インシデント発生時のフィードバック共有。具体的事例に基づく注意喚起

教育で最も重要なのは、「AIを使うな」ではなく「AIを正しく使おう」というメッセージを一貫して発信することです。AIエージェントの進化を見れば分かるように、AIは今後ますます業務に不可欠なツールになります。使わせないことではなく、安全に使える環境を整えることが組織の責任です。

体制構築の現実的なステップ

「いきなり委員会を設置するのはハードルが高い」と感じる方もいるかもしれません。その場合は、以下の3ステップで段階的に進めてください。

- ステップ1(今週中):AI推進責任者を1人決める。ITに詳しい人でなくても構いません。「AIのことはこの人に聞く」という窓口を明確にするだけで、社内のAI利用状況の把握が始まります

- ステップ2(1か月以内):承認済みツールのリストと入力禁止データのカテゴリーを決め、全社に周知する。この2つがあるだけで「何をやっていいか」が明確になり、シャドーAIのリスクが大幅に低減します

- ステップ3(3か月以内):教育担当と部門AI推進担当を任命し、四半期レビューのサイクルを開始する。最初の四半期レビューでは「ツールの利用状況」と「入力禁止データの遵守状況」の2点だけを確認すれば十分です

大切なのは、最初から完璧な体制を目指さないことです。1人の責任者から始めて、四半期ごとに体制を拡充していく。この「育てるアプローチ」が、中小企業のAIガバナンスには最も適しています。組織のセキュリティ体制を育てることは、いわば盆栽を手入れするのと同じで、焦らず着実に形を整えていくことが大切です。

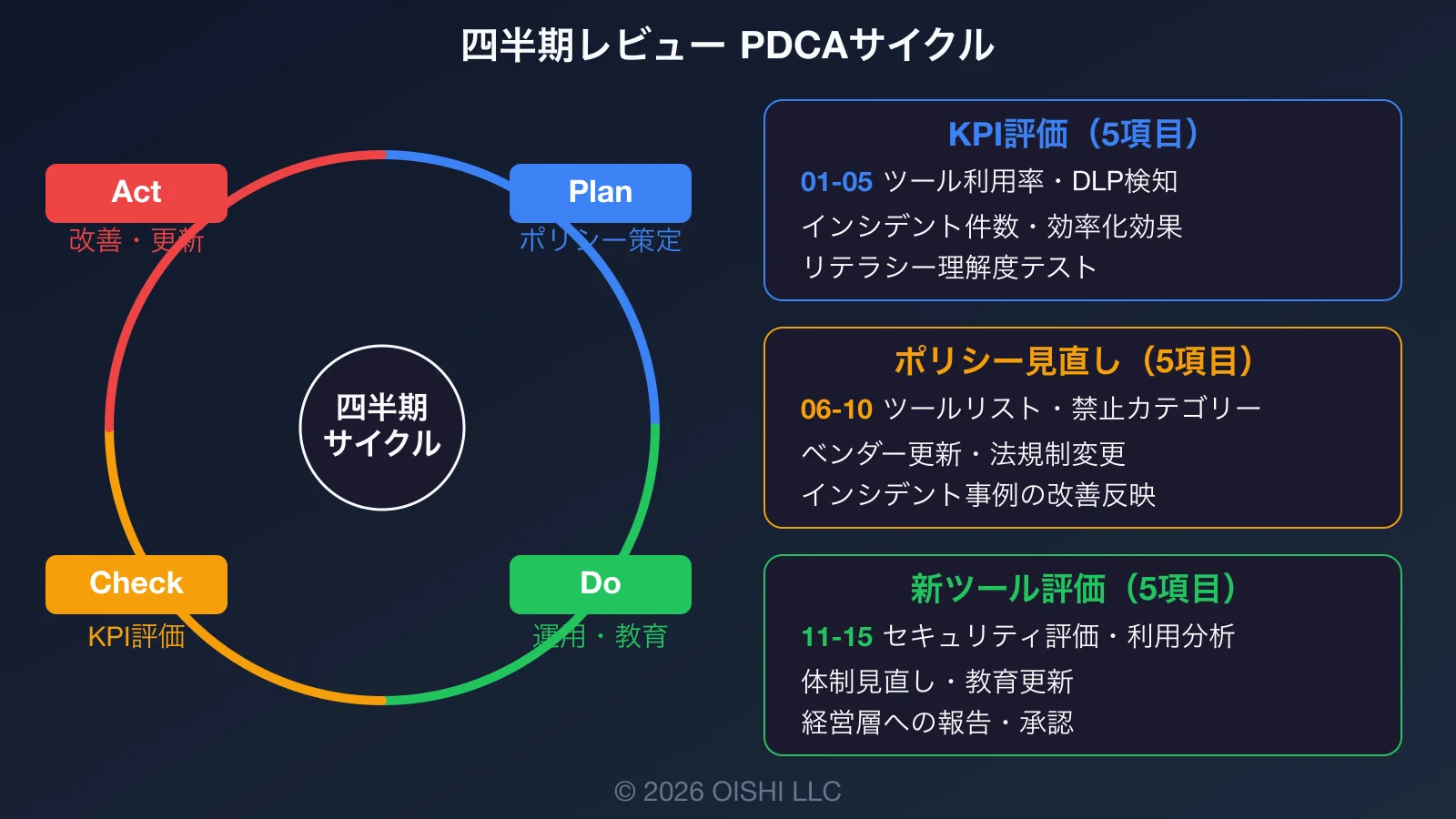

6. 四半期レビューチェックリスト:PDCAを回す15項目

AIガイドラインは「生き物」です。言い換えれば、ガイドラインは完成した建物ではなく、常に手入れが必要な庭のようなものです。AI技術は四半期ごとに大きく変化するため、ガイドラインとセキュリティ対策も定期的に見直す必要があります。以下の15項目を四半期ごとにレビューしてください。

KPI評価(5項目)

- 公式AIツールの利用率は目標値に達しているか:目標は「シャドーAI利用率の低下」ではなく「公式AI利用率の上昇」で設定する

- DLPによる機密データ検知件数の推移を確認したか:検知件数の減少は教育効果の表れ。増加は追加教育が必要なサイン

- AI関連インシデントの発生件数と対応時間を評価したか:平均対応時間(MTTR)を追跡し、改善傾向にあることを確認する

- AIによる業務効率化の効果を定量的に測定しているか:セキュリティ投資の費用対効果を経営層に説明するためのデータ収集

- 社員のAIリテラシー理解度テストを実施したか:簡単な5問テストでも良い。理解度の低い部門には追加研修を実施

ポリシー見直し(5項目)

- 承認済みAIツールリストを更新したか:新しいAIサービスの追加・廃止を反映。市場の変化に対応する

- 入力禁止データのカテゴリーを見直したか:事業内容の変化や新規取引先のNDAに合わせてカテゴリーを更新

- ベンダーのセキュリティアップデートを確認したか:各AIプラットフォームの料金変更、認証取得、新機能のリリースを確認

- 法規制の変更を確認し、ガイドラインに反映したか:個人情報保護法の改正、業界固有の規制変更に対応

- インシデント事例を踏まえてガイドラインを改善したか:自社で発生したインシデント、および同業他社の事例を教訓として反映

新ツール評価・改善(5項目)

- 新しいAIツール・機能のセキュリティ評価を実施したか:導入前チェックリスト15項目を適用して評価

- 既存ツールの利用状況をログから分析したか:使われていないツールはコスト削減のため解約を検討。逆に、要望が多いツールの導入を検討

- 組織体制の役割分担に変更が必要ないか確認したか:担当者の異動・退職に伴う引き継ぎ、新たな役割の追加

- 教育プログラムの内容を更新したか:前四半期のインシデント事例、新しいAI活用テクニック、最新のリスク情報を反映

- レビュー結果を経営層に報告し、次四半期の計画を承認されたか:セキュリティは経営課題。IT部門だけの取り組みにしない

筆者は、中小企業こそチェックリストが有効だと確信しています。大企業にはセキュリティの専門部署がありますが、中小企業にはない場合がほとんどです。だからこそ、属人化しない「仕組み」としてのチェックリストが必要なのです。PoC地獄から抜け出すロードマップでも触れましたが、仕組み化しないとスケールしません。

四半期レビューを形骸化させないコツ

チェックリストを作っても、レビューが形骸化すれば意味がありません。実際に機能するレビューにするための3つのコツを共有します。

- レビュー会議は60分以内:長時間の会議は参加者の集中力が低下し、形式的になりがちです。15項目のチェックリストを事前に各担当者が記入し、会議では「課題がある項目」だけを議論する形にすれば、60分以内で完了できます

- レビュー結果を1枚のサマリーにまとめる:経営層への報告は、A4一枚のサマリーで十分です。「前四半期の主要KPI」「検出された課題」「次四半期のアクションプラン」の3つに絞ることで、経営層の意思決定を促しやすくなります

- 「変化がなかった」も立派な報告:四半期レビューで「特に問題なし」という結果が出ることは健全な状態です。重要なのは「確認した上で問題なし」と言えること。確認せずに「多分大丈夫」とは根本的に異なります

よくある質問

Q1. チェックリスト50項目すべてを一度にやる必要がありますか?

いいえ、段階的に進めるのが現実的です。まず「導入前チェックリスト」の中でも特に重要な3項目(学習利用ポリシー・DPA・SSO)から着手し、運用チェックリストは導入後に順次整備してください。100点を目指して動けなくなるより、60点で今すぐ始める方が価値があります。

Q2. 専任のセキュリティ担当者がいない中小企業でも対応できますか?

対応できます。本記事のチェックリストは、専門知識がなくても「はい/いいえ」で確認できるように設計しました。組織体制も、1人が複数の役割を兼任する前提で記述しています。まずはIT管理者がセキュリティ管理者を兼任し、ガイドラインの策定から始めてください。

Q3. 社内AIガイドラインの策定にどのくらいの期間がかかりますか?

本記事のテンプレートを使えば、最短1週間で初版を策定できます。セクション3(承認済みツール)とセクション4(入力禁止データ)を決めれば、最低限のガイドラインとして運用を開始できます。完璧を目指す必要はありません。四半期ごとに改善していけばよいのです。

Q4. サプライチェーンセキュリティ対策評価制度の★評価を取得するには?

2026年度下期の運用開始が予定されていますが、詳細な評価基準はまだ最終確定していません。ただし、本記事のチェックリストを実施していれば、評価基準の「識別」「防御」「検知」カテゴリーの多くをカバーできます。制度が正式に開始された際にスムーズに対応できる状態を今から整えておくことが重要です。

Q5. このチェックリストはどのくらいの頻度で更新すべきですか?

四半期ごとの見直しを推奨します。AI技術の進化は速く、半年前の常識が通用しなくなることがあります。四半期レビューチェックリスト(セクション6)に従って定期的に見直し、新しいリスクや技術変化を反映してください。

まとめ

本記事では、AIセキュリティ対策チェックリスト50項目を、導入前(15項目)・運用中(20項目)・四半期レビュー(15項目)の3フェーズで整理しました。さらに、社内AIガイドラインのテンプレートと組織体制の設計図も提供しています。

AI×セキュリティシリーズ全3回を振り返ります。第1回(シャドーAI対策)では、社員の無断AI利用が企業にもたらすリスクと、全面禁止ではなくガバナンスで対応する方法を解説しました。第2回(セキュリティ比較)では、4大AIプラットフォームを14項目で徹底比較し、自社に最適なプラットフォームの選び方を示しました。そして本記事では、実践的なチェックリストとガイドラインテンプレートで「明日から何をすべきか」を明確にしました。

最後に、筆者からの3つのメッセージです。

- チェックリストは「守り」ではなく「攻めの武器」です。取引先への信頼アピール、サプライチェーン評価制度への先行対応、社員のAI活用力向上──チェックリストは企業の競争力を高めるツールです

- 完璧なセキュリティより「説明できるセキュリティ」が重要です。「うちのAI大丈夫?」に対して、根拠をもって「こういう体制で管理しています」と答えられることが目標です

- まず今週、1つだけでも始めてください。承認済みAIツールのリストを作る、入力禁止データを決める、SSO設定を確認する──どれか1つで構いません。完璧を目指して動けなくなるより、不完全でも今すぐ始める方がはるかに安全です

参照元

- IPA「情報セキュリティ10大脅威 2026」

- IPA プレスリリース「情報セキュリティ10大脅威 2026 を決定」(2026年1月)

- 経済産業省「サプライチェーン強化に向けたセキュリティ対策評価制度 中間取りまとめ」(2025年4月)

- 経済産業省「サプライチェーンセキュリティ対策評価制度 制度構築方針(案)」(2025年12月)

- 経済産業省・総務省「AI事業者ガイドライン(第1.1版)」(2025年3月)

- NIST Cybersecurity Framework 2.0

- OpenAI「Enterprise privacy at OpenAI」

- Anthropic Trust Center

- Google Cloud「Compliance certifications and security controls – Gemini Enterprise」

- Microsoft「Data, Privacy, and Security for Microsoft 365 Copilot」

- LANSCOPE「生成AIガイドラインとは?企業に役立つひな型を公開」